AI開発企業のSubquadraticがAIモデル「SubQ」を発表しました。SubQは主流のTransformerベースAIモデルとは異なるアーキテクチャで開発されたモデルで、最大1200万トークンという長大なコンテキストウィンドウを備えています。また、テストモデルである「SubQ 1M-Preview」は長大トークンを入力した際の処理性能でClaude Opus 4.7を大きく上回っています。

Subquadratic — Efficiency is Intelligence

https://subq.ai/

Introducing SubQ: The First Fully Subquadratic LLM

https://subq.ai/introducing-subq

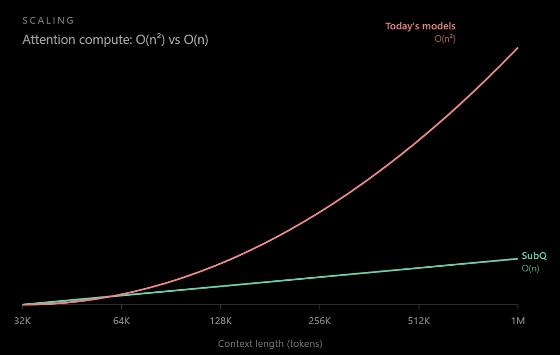

記事作成時点で主流のAIモデルは「Transformer」という機械学習アーキテクチャに基づいて開発されています。Subquadraticによると、TransformerベースのAIモデルには「入力トークンが増加すると、必要な計算量が2乗に比例して増加する」という問題があるとのこと。Subquadraticが開発したAIモデル「SubQ」はTransformerとは異なる効率的なアーキテクチャを採用しており、計算量は入力トークンに比例して増加します。つまり、入力トークンが増えるほど既存のAIモデルと比べて効率的な処理が可能となります。

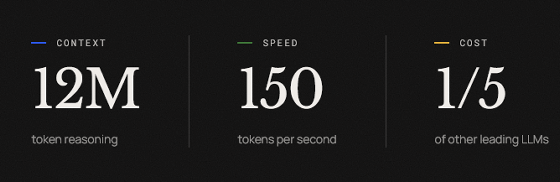

SubQは最大1200万トークンの入力に対応し、既存のAIモデルと比べて1トークン当たり150倍のスピードで動作しつつコストを5分の1に抑えることができます。

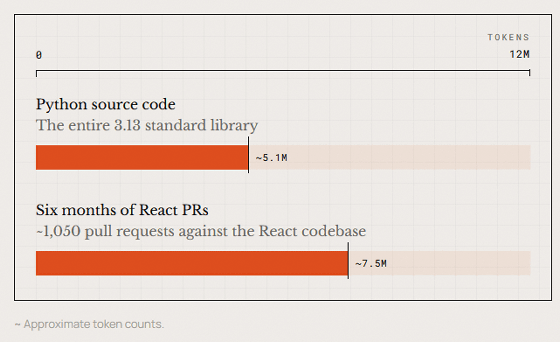

参考までに、Python 3.13の標準ライブラリを含むソースコード全体のトークン数は510万で、Reactの開発プロジェクトに半年で投稿されたプルリクエストの合計トークン数は750万とのこと。SubQはこれらのコードを一度に処理することができます。

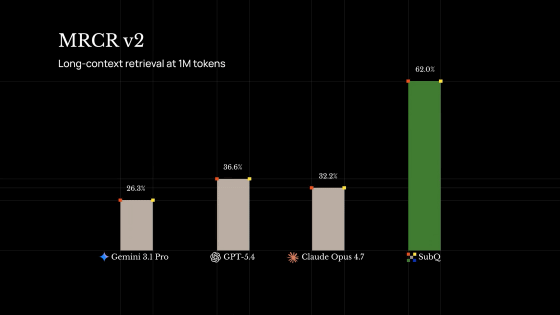

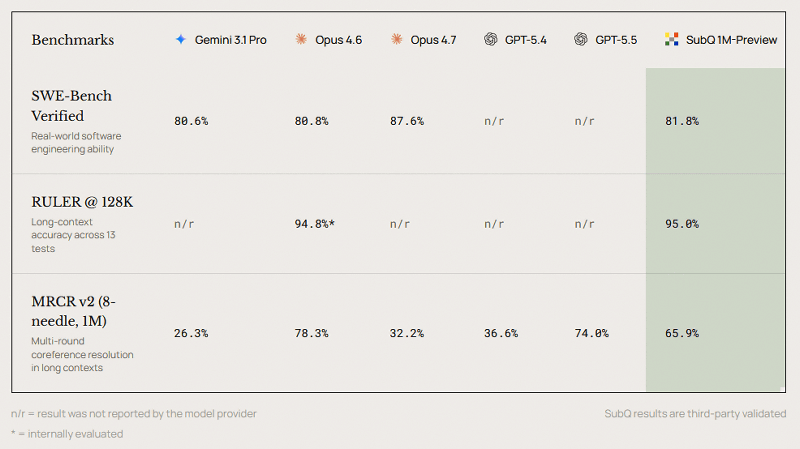

SubQのテスト版であるSubQ 1M-Previewと「Gemini 3.1 Pro」「Claude Opus 4.6」「Claude Opus 4.7」「GPT-5.4」「GPT-5.5」のベンチマーク結果を比較した表が以下。SubQ 1M-Previewはコーディングエージェント性能を測定するSWE-Bench VerifiedでGemini 3.1 ProとClaude Opus 4.6を超えるスコアを記録。また、長文理解能力を評価するベンチマークのMRCR v2の100万トークン入力テストではClaude Opus 4.7を上回りました。

SubQはコーディングエージェントのSubQ Codeと情報分析AIのSubQ Searchがプライベートベータ版として提供されており、APIの早期アクセスも始まっています。

この記事のタイトルとURLをコピーする

・関連記事

iPhone 17 Proでパラメーター数80億のAIモデル「1-bit Bonsai 8B」をローカル実行してみたよレビュー、無料アプリのLocally AIで簡単に実行できる – GIGAZINE

iPhoneでも動作する80億パラメーターの省メモリAI「Ternary Bonsai」が登場、「1」「0」「-1」の3値で情報を扱いメモリ使用量はわずか1.75GB – GIGAZINE

Claude Sonnet 4.5超えのフランス製AIモデル「Mistral Medium 3.5」がオープンモデルとして公開される&Mistral Vibeがクラウド対応 – GIGAZINE

アメリカ企業がローカル動作する高性能オープンモデル「Laguna XS.2」をリリース、オープンモデルで躍進する中国勢に対抗できるか – GIGAZINE

XiaomiがClaude Opus 4.6に迫るAIモデル「MiMo-V2.5-Pro」をオープンモデルとして公開 – GIGAZINE

Claude Opus 4.6と同等性能の中国製AIモデル「Kimi K2.6」がオープンモデルとして公開される – GIGAZINE

Gemma4より高性能な中華AI「Qwen3.6-35B-A3B」がオープンモデルとして公開される – GIGAZINE

IBMがAIモデル「Granite 4.1」シリーズを公開、プロンプト追従やツール呼び出しが得意なオープンモデル – GIGAZINE

ソース元はコチラ

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。