Anthropicのマルチエージェントシステム「Claude Research」は複数のAIエージェントが自律的に連携してタスクを処理する仕組みを備えており、AI研究の一部自動化につながる可能性が指摘されています。Anthropic共同創業者のジャック・クラーク氏は、「2028年末までに、人間が関与しなくてもAIが次世代AIを研究・開発できる状態に到達する可能性が60%以上ある」とAIに関するニュースレター「Import AI」で主張しています。

Import AI 455: AI systems are about to start building themselves.

https://importai.substack.com/p/import-ai-455-automating-ai-research

I’ve spent the past few weeks reading 100s of public data sources about AI development. I now believe that recursive self-improvement has a 60% chance of happening by the end of 2028. In other words, AI systems might soon be capable of building themselves.

— Jack Clark (@jackclarkSF) 2026年5月4日

クラーク氏は、近年のAIのコーディング能力や自律的な研究能力の急速な進歩を根拠として「AI研究がエンドツーエンドで自動化される時代に生きていると信じている」と述べています。その上で、「この進歩が進むと、私たちは予測不可能な未来へとルビコン川を渡る(後戻りできない段階に進む)ことになるだろう」とクラーク氏は指摘し、自律的に後継システムを構築できるほど強力なAIシステムが2028年末までに実現する可能性が60%以上あるという見解を主張しました。

クラーク氏が根拠として挙げたのは、近年のAI能力の急激な向上です。例えば、ソフトウェア開発能力を測定する「SWE-Bench」では、2023年時点の最高スコアはClaude 2が記録した約2%程度だったのに対し、2026年4月に公開された「Claude Mythos Preview」は93.9%を記録しました。一部のSWE-Benchには重大な問題があり、最上位のスコアと上位のスコアを有意に識別できているかには疑いがあるという指摘もありますが、数年で大幅に向上したことは間違いありません。

また、AIシステムがAIシステム自体の研究開発を行う能力を評価することに焦点を当てる研究組織であるMETRの推定では、AIが人間の介入なしで継続して作業できる時間も急速に延びていることが示されています。2022年のGPT-3.5は約30秒規模のタスクしか処理できなかったのに対し、2024年のGPT-4 o1では4分に増加し、2025年にはGPT 5.2(High)が約6時間を達成しました。そして、2026年2月に発表されたClaude Opus 4.6は約12時間規模のタスクを実行できる段階に達しているとされています。

AnthropicがClaude Opus 4.6を発表、コーディングだけでなく財務処理や文書作成の性能も向上&最大100万トークンのコンテキストウィンドウに対応 – GIGAZINE

METRで長年AI予測を行っているアジェヤ・コトラ氏は、2026年1月に立てたAIの進歩に関する予測は2カ月後には控えめだったと感じられるほど進歩はめざましいとした上で、「2026年末までにAIシステムの処理時間は100時間を超えるだろう」と予測を述べています。

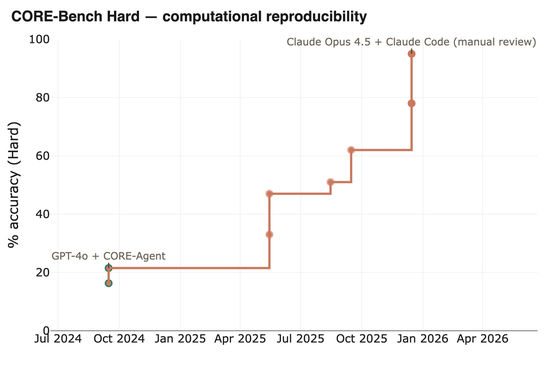

クラーク氏によると、AI研究者のタスクの多くは天才的なひらめきではなく、データのクリーニング、データの読み取り、実験の開始など、人間が数時間かけて行う地道な作業に集約されるとのこと。AIの連続処理時間が十分に伸びると、AI研究者の作業はすべて範囲内に収まると考えられるそうです。例えば、AI研究の重要な仕事の1つは科学論文を読んでその結果を再現することですが、計算再現性エージェントベンチマークであるCORE-Benchにおいて、発表当初の約21.5%という最高スコアから約1年で95.5%まで到達したことが報告されているほど、AIの処理能力は向上しています。

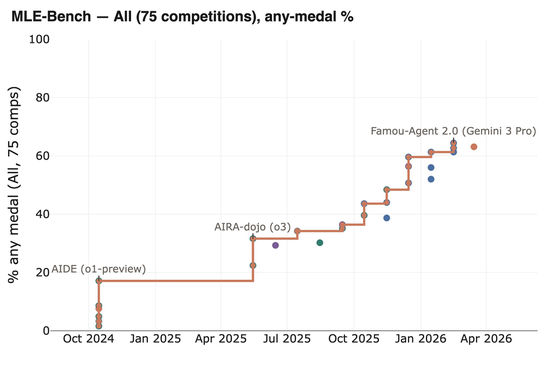

また、特定の課題を解決するために非常に多様なセットのMLアプリを構築するMLE-Benchにおいても、同様の発展が見られます。

さらにクラーク氏は、AIがすでにAI研究そのものを部分的に自動化し始めていると指摘しています。Anthropicが2026年4月に公開した自動アライメント研究の概念実証では、急速に進歩するAIを人間が管理しきれるのか検証する実験を行いました。実験では人間またはClaude Opus 4.6の監督の下、AIがAIに最良の回答を提供するためのファインチューニングを行い、どの程度性能が向上するか記録されています。結果として、人間の監視下ではスコアが0.23だったのに対し、Claude Opus 4.6は最終的に0.97のスコアを出し、大きく差を付けて高いスコアを記録しました。Anthropicは「AIがスコアを改善したことは、最先端のAIがすでにAIアライメント科学者になったことを意味するわけではありません」と注意を述べつつも、AIがAIを監視する将来の可能性を示唆しています。

人間は賢くなり続けるAIを監視しきれるのか?AnthropicがAIでAIを監視する実験を行う – GIGAZINE

一方でクラーク氏は、こうした進歩が「再帰的自己改善」につながる可能性についても警告しています。AIが自ら研究開発を高速化し始めた場合、幅広い問題に共通して発生し得る基本的な「複合誤差」が発生し、わずかな誤差でもAIがAIを繰り返し生成する過程で累積する可能性があります。仮に「99.9%正確」なシステムができたとしても、50世代後には95.12%、500世代後には60.5%に精度が低下するため、AIがAIを管理し続けるだけでは正確さを維持することができないという理論的懸念があります。また、仮にAIがAIを構築することが当然なレベルまで進歩した場合、経済や社会構造に極めて大きな影響を与えるため、さまざまな社会的または政治的トラブルが発生する可能性があります。

こうした全てのデータや見解を踏まえた上で、クラーク氏は「2028年末までに自動化されたAI研究開発、すなわち最先端モデルが自律的に後継バージョンを学習できるようになる可能性は約60%ある」と結論付けています。2027年に実現する確率は30%程度で、その理由はAI研究に必要な創造性と異端的な洞察力について2026年時点ではAIシステムは革新的かつ大きな形で示していないため、さらなる進歩が必要であるためです。また、2028年末までに実現しない場合は、現在の技術パラダイムに根本的な欠陥があることが明らかになったと考えられるため、実現には何らかの発明が必要になるとクラーク氏は述べています。

この記事のタイトルとURLをコピーする

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。