中国のAI企業・AlibabaのAI研究チームであるQwen(Tongyi Lab)が270億パラメータのマルチモーダルAIモデル「Qwen3.6-27B」を公開しました。ライセンスはオープンなApache License 2.0で、商用利用も可能となっています。

Qwen3.6-27B: Flagship-Level Coding in a 27B Dense Model

https://qwen.ai/blog?id=qwen3.6-27b

1/4 Compact Size, Flagship Coding. Qwen3.6-27B is officially open source.

Qwen3.6-27B delivers flagship-level agentic coding performance, surpassing the previous-generation open-source flagship Qwen3.5-397B-A17B across all major coding benchmarks.Core Capabilities:

• Agentic… pic.twitter.com/YNm8oLtLYb— Tongyi Lab (@Ali_TongyiLab) 2026年4月22日

Qwenチームは2026年4月2日にQwen3.6シリーズを発表し、フラグシップモデルとして「Qwen3.6-Plus」をリリースしました。Qwen3.6-Plusの発表では「今後小規模化したバージョンをオープンソースライセンスで公開予定」と記述されており、今回の「Qwen3.6-27B」がQwen3.6-Plusを小規模化したものにあたります。

Qwen3.6-Plusが登場、自律的にタスクを遂行するエージェント機能が強み – GIGAZINE

QwenはほかにもQwen3.6-35B-A3Bを2026年4月15日に公開済み。Qwen3.6-35B-A3Bはわずか3B(30億)のアクティブパラメータという軽快な動作ながら高い性能を確保している点が特徴でした。

Gemma4より高性能な中華AI「Qwen3.6-35B-A3B」がオープンモデルとして公開される – GIGAZINE

今回リリースされたQwen3.6-27Bは270億パラメータで、思考モードと非思考モードの両方に対応。Qwen3.6シリーズはすべて画像や動画に対応したマルチモーダルなモデルであり、今回のQwen3.6-27Bもマルチモーダルモデルとなっています。実用的で広範囲に展開可能な規模のモデルとして最高レベルのエージェントコーディング能力があるとのこと。

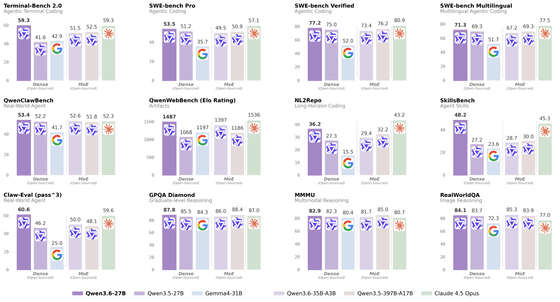

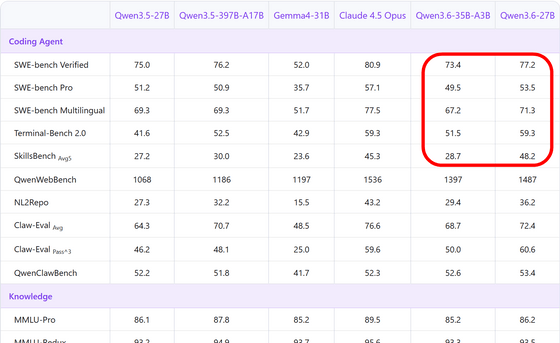

以下はQwenが発表したベンチマークで、前モデルのQwen3.5-27BやGoogleが2026年4月2日に公開したオープンモデル「Gemma4-31B」を12種のベンチマークすべてで上回っているほか、Anthropicの2世代前の最上位モデル「Claude 4.5 Opus」を超えるスコアを出しているものもあります。

また、「SWE-bench Verified」「SWE-bench Pro」「Terminal-Bench 2.0」「SkillBench」など主要なコーディングベンチマークで総パラメーター数3970億のQwen3.5-397B-A17Bモデルを凌駕するスコアを記録。エージェントコーディングが得意であることを示しました。

Qwen3.6-27BはウェイトのデータがHugging FaceとModalScopeで公開されており、ダウンロードしてセルフホストが可能なほか、今後Alibaba Cloud Model Studioに登場してAPI経由での利用が可能になる予定とのこと。OpenClaw、Claude Code、Qwen Codeといった人気の高いサードパーティ製コーディングアシスタントとシームレスに統合でき、開発ワークフローを効率化して優れたコーディング体験を実現できるとされています。また、開発チームによるFP8量子化版も同時公開されています。

Qwen/Qwen3.6-27B · Hugging Face

https://huggingface.co/Qwen/Qwen3.6-27B

Qwen/Qwen3.6-27B-FP8 · Hugging Face

https://huggingface.co/Qwen/Qwen3.6-27B-FP8

Qwenは「Qwen3.6-27Bは開発者にとって重要なタスクにおいてはるかに大規模な3970億パラメータのQwen3.5-397B-A17Bを上回り、しかも導入と運用は容易です。Qwen3.6-27Bが公開されたことでQwen3.6シリーズが包括的なモデル群を提供するようになり、あらゆる規模でエージェントコーディングがブレークスルーを達成した世代を象徴しています。これらのモデルを使ってどのようなものが構築されるのか楽しみにしています」と述べました。

この記事のタイトルとURLをコピーする

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。