AMDが2025年6月12日(木)にAIインフラストラクチャー向けの高性能GPU「Instinct MI350シリーズ」を発表しました。AMDはInstinct MI350シリーズがNVIDIAのGB200やB200と比べて高性能であることをアピールしています。

AMD Instinct™ MI350 Series GPUs

https://www.amd.com/en/products/accelerators/instinct/mi350.html#tabs-ee243cf344-item-b81b4672ea-tab

AMD Instinct MI350 Series and Beyond: Accelerating the Future of AI and HPC

https://www.amd.com/en/blogs/2025/amd-instinct-mi350-series-and-beyond-accelerating-the-future-of-ai-and-hpc.html

AMD Advancing AI Keynote – YouTube

Instinct MI350シリーズを発表するリサ・スーCEO。

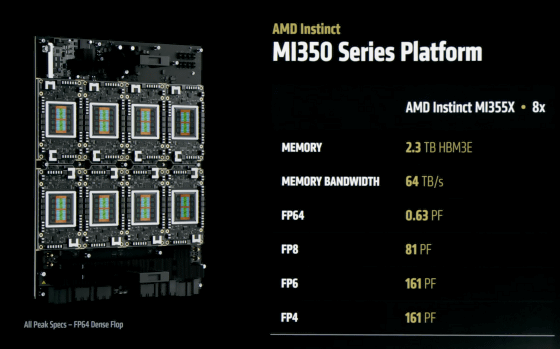

ボードに組み込んだ際の見た目はこんな感じ。

Instinct MI350シリーズには「Instinct MI355X」と「Instinct MI350X」が含まれています。上位モデルのInstinct MI355XはメモリにHBM3Eを採用しており、メモリ容量は288GB、メモリ帯域幅は毎秒8TBです。

Instinct MI355XとInstinct MI350Xのスペックは以下の通り。

| 製品名 | Instinct MI355X | Instinct MI350X |

|---|---|---|

| GPU | Instinct MI355X OAM | Instinct MI350X OAM |

| GPUアーキテクチャ | CDNA 4 | CDNA 4 |

| メモリ容量 | 288 GB HBM3E | 288 GB HBM3E |

| メモリ帯域 | 8 TB/s | 8 TB/s |

| FP64パフォーマンス | 78.6 TFLOPS | 72 TFLOPS |

| FP16パフォーマンス | 5 PFLOPS | 4.6 PFLOPS |

| FP8パフォーマンス | 10.1 PFLOPS | 9.2 PFLOPS |

| FP6パフォーマンス | 20.1 PFLOPS | 18.45 PFLOPS |

| FP4パフォーマンス | 20.1 PFLOPS | 18.45 PFLOPS |

Instinct MI350シリーズを8台組み合わせてInstinct MI350シリーズプラットフォームを構成可能。Instinct MI355Xを8台組み合わせるとメモリ容量は2.3TBに達します。

Instinct MI355XプラットフォームとInstinct MI350Xプラットフォームのスペックは以下の通りです。

| 製品名 | Instinct MI355X プラットフォーム | Instinct MI350X プラットフォーム |

|---|---|---|

| GPU | Instinct MI355X OAM 8台 | Instinct MI350X OAM 8台 |

| GPUアーキテクチャ | CDNA 4 | CDNA 4 |

| メモリ容量 | 2.3 TB HBM3E | 2.3 TB HBM3E |

| メモリ帯域 | 1台ごとに8 TB/s | 1台ごとに8 TB/s |

| FP64パフォーマンス | 628.8 TFLOPS | 577 TFLOPS |

| FP16パフォーマンス | 40.2 PFLOPS | 36.8 PFLOPS |

| FP8パフォーマンス | 80.5 PFLOPS | 73.82 PFLOPS |

| FP6パフォーマンス | 161 PFLOPS | 147.6 PFLOPS |

| FP4パフォーマンス | 161 PFLOPS | 147.6 PFLOPS |

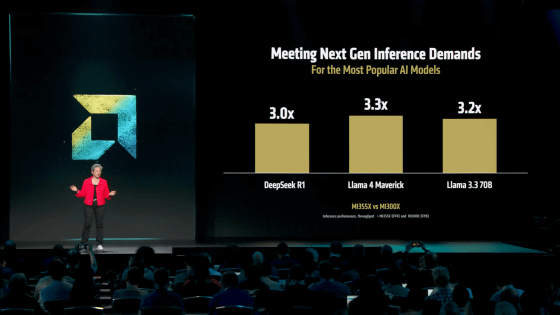

Instinct MI355Xは2023年に登場したInstinct MI300Xと比べて大幅な性能向上を果たしており、DeepSeek-R1では3倍、Llama 4 Maverickでは3.3倍、Llama 3.3 70Bでは3.2倍高速な推論が可能です。

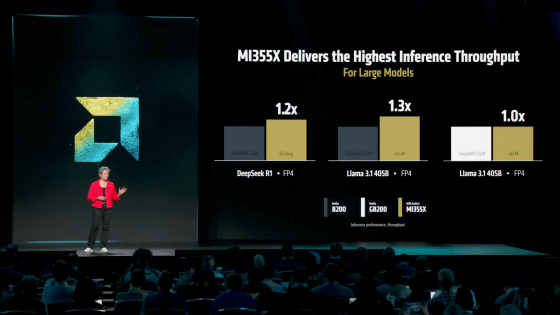

AMDはInstinct MI350シリーズがNVIDIAのGB200やB200と比べて高い性能を備えていることをアピールしています。AMDいわく、Instinct MI350シリーズはB200と比べてメモリ容量が1.6倍でFP64における処理性能が2.1倍とのこと。

実際のAIワークロードでは、Instinct MI355XはB200と比べてDeepSeek-R1の推論性能が1.2倍、Llama 3.1 405Bの推論性能が1.3倍とされています。

Instinct MI350シリーズはDellやHPE、Supermicroなどのサービスを介して利用可能になる予定です。

この記事のタイトルとURLをコピーする

ソース元はコチラ

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。