オープンソースのインメモリデータベース「Redis」を開発したサルヴァトーレ・サンフィリッポ氏が、ローカル環境で大規模AIモデルを高速動作させるためのコンパクトな推論エンジン「DwarfStar 4」を公開しました。DwarfStar 4は中国のAI企業・DeepSeekの「DeepSeek V4 Flash」に特化しており、モデルを正しく高速に実行することに加えてさまざまな処理をクラウド経由ではなくローカルPCで直接実行することを目的としています。

GitHub – antirez/ds4: DeepSeek 4 Flash local inference engine for Metal and CUDA · GitHub

https://github.com/antirez/ds4

A few words on DS4 –

https://antirez.com/news/165

一般的なローカルAIツールは多数のAIモデルを幅広く動かすことを目指していますが、DwarfStar 4は逆に「1つのモデルへ特化する」という設計思想を採用しています。DwarfStar 4は2026年4月に中国のAI企業であるDeepSeekがリリースした「DeepSeek v4 Flash」に特化しています。

ついに「DeepSeek-V4」が登場、Claude Opus 4.6を超える性能のオープンモデル – GIGAZINE

DeepSeek V4 Flashを選んだ理由として、サンフィリッポ氏は「100万トークンのコンテキストウィンドウを備えている」「アクティブなパラメータが少ないためより高速に動作」「思考モードでは推論を必要以上に長引かせることを避けることで他のモデルよりもはるかに短い思考セクションが生成される」「英語とイタリア語の記述能力が格段に向上している」などを挙げています。

サンフィリッポ氏によると、DwarfStar 4はGPT 5.5を活用しつつも、アイデア出しやテスト、デバッグは人間主導で開発されたとのこと。また、llama.cppと、多くの部分が手作業で最適化されたGGMLなしには成立しなかったとサンフィリッポ氏は述べています。

DwarfStar 4で特徴的なのが「非対称2bit/8bit量子化」と呼ばれる技術です。通常、大規模言語モデルは数百GB規模の巨大メモリを必要とするため、クラウドベースで動作することが一般的です。しかし、DwarfStar 4はllama.cppプロジェクトによって切り開かれた量子化フォーマットによってモデルの重みデータを圧縮することで、メモリの消費量を大幅に削減できたそうです。結果として、DwarfStar 4は128GBのRAMを搭載したMacBookで快適に動作したほか、96GBでも25万トークンのコンテキストウィンドウが動作したと報告されています。

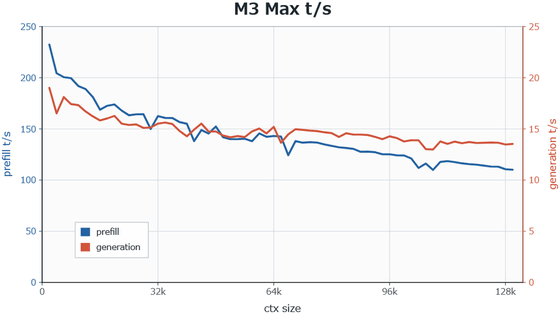

以下は、Apple M3 Max搭載MacBookでDwarfStar 4を実行した際の性能を示したグラフ。コンテキストサイズ(横軸)が増加するにつれてトークン生成速度(縦軸)は低下するものの、10万トークンを超えても実用的な速度を維持しています。

DwarfStar 4はGitHubで9000以上の「スター」を獲得するなど、注目を集めています。サンフィリッポ氏はブログで「こんなに早く人気になるとは予想していませんでした。単一モデル統合に焦点を当てたローカルAI体験へのニーズがあったことは明らかでしたが、ローカル推論の常識を変えるほど大規模で高速なモデルがリリースされたこと、そして2bit/8bitの非常に非対称な量子化手法で非常にうまく機能し、96GBまたは128GBのRAMで実行できるという事実が示されたこと、そしてGPT 5.5のおかげでより迅速に活用できるようになったことがほとんど同時に起こったため、成功につながりました」と語りました。

ソーシャルニュースサイトのHacker NewsでもDwarfStar 4が話題になっており、「Claudeと比べてもちろん処理速度ははるかに遅いですが、著しく性能が劣っているとは思わないほど、Claudeにこれほど近い感覚なのは驚きです」と称賛するコメントや、他のオープンソースモデルと比べてツール呼び出しの信頼性が高いということを指摘するコメント、「長いコンテキスト推論は最先端モデルでさえ見たことがないもの」と驚くコメントなど、高い評価が集まっています。「自転車に乗ったペリカン」をAIに描かせる独自のベンチマークを考案したエンジニアのサイモン・ウィリソン氏も「先日、128GBのM5でDwarfStar 4を動作させてみました。非常に簡単で、モデルは約80GBのRAMで動作し、コードの記述とツールの実行において非常に高い能力を発揮しているようでした」と評価しています。

この記事のタイトルとURLをコピーする

ソース元はコチラ

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。