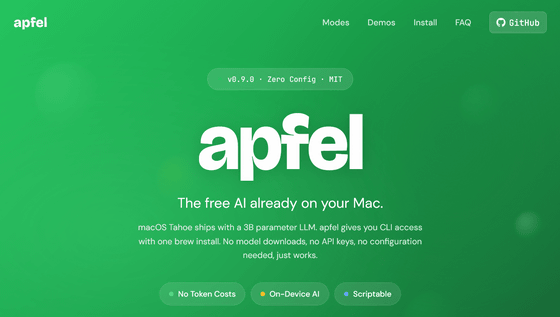

Apple独自のオンデバイスローカルAIモデルであるFoundation Modelsは、基本的にApple Intelligenceを通じてのみ公開されています。「apfel」はAPIキーやサブスクリプション不要で使用できるソフトウェアで、Apple Intelligenceに組み込まれているFoundation Modelsを実際に利用することができます。

apfel – Your Mac Already Has AI

https://apfel.franzai.com/

macOS TahoeではApple Intelligenceのオンデバイス基盤モデルとして、約30億パラメータのFoundation Modelsが利用可能です。apfelを使えばモデルのダウンロードもAPIキーも設定も不要でインターフェースにアクセスしてモデルを直接使用できます。

apfelの特徴として、macOS Tahoeに搭載されているLLMを利用するものであるため、トークンごとの課金やサブスクリプションなどは不要です。また、全てのトークンはAppleシリコン上でローカルに生成されるため、データが外部に送信されない設計になっているとのこと。

以下は、AppleのMachine Learning Researchに基づいたFoundation Modelsのスペックをまとめた表。パラメータは最大30億で、モデルが一度に処理できるトークン数(コンテキストウィンドウ)は4896。言語は英語、オランダ語、スペイン語、フランス語、イタリア語、日本語、韓国語、ポルトガル語、中国語をサポートしています。

また、apfelはモデルコンテキストプロトコル(MCP)に対応しています。任意のMCPサーバーに接続すれば、デバイス上のモデルは数学、API、データベースなど、サーバーを構築できるさまざまな外部ツールを利用できるようになります。概念実証として電卓MCPサーバーが同梱されています。

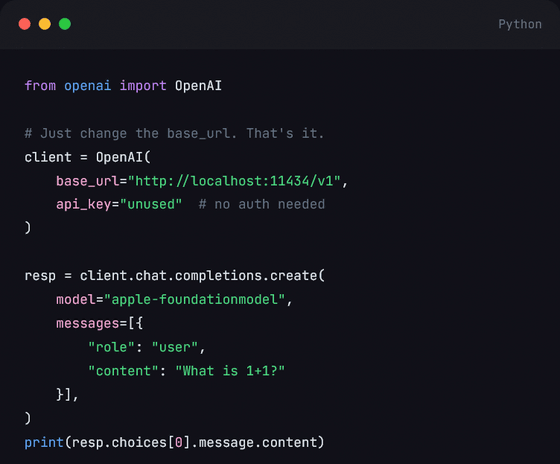

そのほか、apfelはOpenAI APIに対応しています。OpenAIと連携するクライアントライブラリ、フレームワーク、ツールであればどれでもMacのAIと連携可能で、ベースURLを変更するだけでツール呼び出しや関数呼び出しが実行できます。つまり、既存のOpenAI向けツールをそのままローカルAIで動かすことも可能です。

apfelを使用するためにはmacOS 26 (Tahoe)以降が必要なほか、システム設定から「Apple Intelligence & Siri」を有効にする必要があります。apfelのリポジトリはGitHubで公開されています。

GitHub – Arthur-Ficial/apfel: Apple Intelligence from the command line. On-device LLM via FoundationModels framework. No API keys, no cloud, no dependencies. · GitHub

https://github.com/Arthur-Ficial/apfel

この記事のタイトルとURLをコピーする

ソース元はコチラ

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。