NVIDIAが、音声に基づいて3Dアバターのリアルな顔アニメーションを生成するAI搭載ツール「Audio2Face」をオープンソース化しました。これにより、開発者はAudio2Faceとその基盤となるフレームワークを利用して、ゲームやアプリ向けのリアルな3Dキャラクターを作成できるようになります。

NVIDIA Open Sources Audio2Face Animation Model | NVIDIA Technical Blog

https://developer.nvidia.com/blog/nvidia-open-sources-audio2face-animation-model/

Nvidia is letting anyone use its AI voice animation tech | The Verge

https://www.theverge.com/news/785981/nvidia-audio2face-ai-voice-animation-open-source

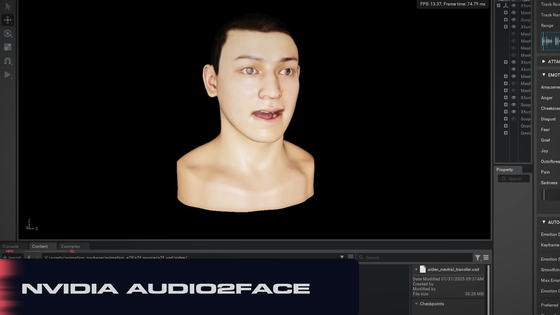

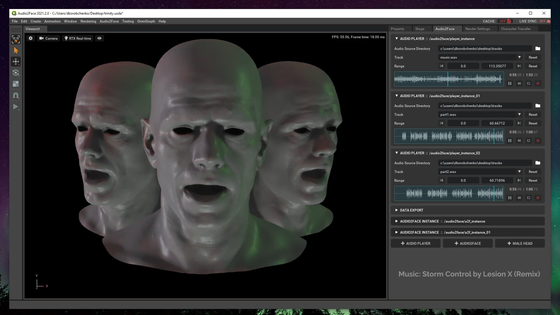

NVIDIAのAudio2Faceは、音声の「音響的特徴」を分析することで、3Dアバターの表情や唇の動きにマッピングするアニメーションデータを生成する技術です。実際にどういうアニメーションが生成されるのかは、以下のムービーを見るとよくわかります。

NVIDIA ACE | New Audio-Driven AI Facial Animation Features Coming to NVIDIA Audio2Face – YouTube

Audio2FaceはAIを活用し、入力された音声から音素やイントネーションなどの音響特性を分析し、アニメーションデータのストリームを作成し、さらにそれをキャラクターの表情にマッピングします。これにより、正確なリップシンクを実現できるのがAudio2Faceの大きな特徴です。

Audio2Faceはすでにゲームや映像制作、広告などで幅広く導入されています。たとえばEA Sportsのレーシングゲーム「F1 25」では、ゲーム中に登場するキャラクターが会話するシーンでのアニメーションにAudio2Faceが使われています。以下のムービーで再生時間6分15秒辺りから開発画面やゲーム中のアニメーションを見ることができます。

F1 25 Authenticity & Customisation Deep Dive – YouTube

今回オープンソース化されるのは、リップシンクを生成するAudio2Faceモデルと、音声から感情状態を推測するAudio2Emotionモデル、Audio2Faceのソフトウェア開発キット(SDK)とAutodesk Maya用プラグイン、Unreal Engine 5用プラグイン、Audio2Faceモデルのトレーニングフレームワーク、Audio2Faceモデルのトレーニングサンプルデータです。各データは以下のページからダウンロード可能です。

ACE for Games | NVIDIA Developer

https://developer.nvidia.com/ace-for-games#section-getting-started

また、ソースコードはGitHubにホストされています。

GitHub – NVIDIA/Audio2Face-3D-SDK: High-performance C++/CUDA SDK for running Audio2Emotion and Audio2Face inference with integrated post-processing.

https://github.com/NVIDIA/Audio2Face-3D-SDK

この記事のタイトルとURLをコピーする

ソース元はコチラ

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。