OpenAIの元CTOであるミラ・ムラティ氏が設立したAIスタートアップのThinking Machines Labが、リアルタイム協働AI「Interaction Models」の研究プレビューを発表しました。

Interaction Models: A Scalable Approach to Human-AI Collaboration – Thinking Machines Lab

https://thinkingmachines.ai/blog/interaction-models/

Introducing interaction models | Thinking Machines Lab – YouTube

既存のAI研究では、AIが自律的に動作する能力をAIモデルの最も重要な機能として扱うことが多いです。その結果、既存のAIモデルやインターフェイスでは、人間が意思決定プロセスに関与し続けることを前提とした最適化が行われていません。

自律型インターフェイスは価値がありますが、実際の業務ではユーザーが要件を事前に完全に指定し、AIに任せっきりにすることはできません。良い結果を得るには、人間が常にプロセスに関わり、途中で明確化やフィードバックを行う協調的なプロセスが不可欠です。しかし、AIを用いるワークフローにおいて人間は排除されつつあります。これは、業務に人間が必要ないからではなく、インターフェイスに人間を受け入れる余地がないためです。

むしろ、人間は他の人と協働する際のように、AIと協働できる必要があります。つまり、必要に応じてメッセージを送ったり、話したり、聞いたり、見たり、見せたり、意見を挟んだりできる必要があるわけです。

こういった問題を解決するために生まれたのが、AIと人間の協働を目指したAIモデルの「Interaction Models」です。Interaction Modelsは外部のフレームワークを介さず、インタラクションをネイティブに処理することができます。Interaction Modelsは音声・動画・テキストを継続的に取り込みながら、リアルタイムで思考・応答・行動することが可能です。

これまでのAIが抱えていた問題について、Thinking Machines Labは「ターン制インターフェイスから脱却する必要がありました」と説明しています。既存のAIモデルは、ユーザーが入力または発話を終えるまで、ユーザーが何をしているのか、どのように行っているのかを認識せずに待機します。そして、ユーザーの入力に応じてAIモデルが生成を終えるまで、AIモデルの認識は停止し、新しい入力を受け取ることはありません。これにより、人間とAIの協働は阻害され、人間の知識や意図、判断がAIモデルに正しく伝わらなくなってしまっていたとThinking Machines Labは説明しています。

Thinking Machines LabはAIをリアルタイムに対話できるようにすることで、より人間がAIインターフェイスに無理矢理合わせるのではなく、AIが人間に合わせて入出力できるような存在に生まれ変わると説明しています。

Thinking Machines LabはInteraction Modelsの必要性について、「既存のAIモデルのほとんどは、ハーネスを使ってインタラクティブ性を後付けしています。つまり、コンポーネントをつなぎ合わせ、中断・マルチモーダル性・並行性を模倣しているわけです。しかし、このような手作業で構築されたシステムでは、汎用的な機能の進歩に追いつけなくなりつつあります。インタラクティビティが知能に合わせて拡張されるには、インタラクティビティ自体がAIモデルの一部でなければいけません。このアプローチにより、AIモデルを拡張し、よりスマートでより優れたコラボレーターとすることが可能です」と語りました。

Interaction Modelsの最大の特徴は、シームレスな対話管理機能です。Interaction Modelsはユーザーが考えているのか、AIに発言を譲っているのか、応答を求めているのかなどを追跡することが可能。実際に以下の動画でInteraction Modelsが人間とどのように対話するのかを見ることができます。

Dialog management | Thinking Machines Lab – YouTube

さらに、Interaction Modelsはユーザーが話し終えたタイミングだけでなく、状況に応じ、あるいは必要に応じて会話に介入することができます。

以下の動画ではPCの前に座っているユーザーがだらりとイスに座っていることを視覚的に検知すると、Interaction Modelsが反応する様子が確認できます。

Visual interjection | Thinking Machines Lab – YouTube

以下の動画では、ユーザーがInteraction Modelsと会話しながら子どものサイクリング旅行について検討しています。ユーザーがInteraction Modelsの発話中にしゃべりかけても、Interaction Modelsはユーザーの発声内容を検討し、出力を調整することが可能。リアルタイムでのやり取りはまるで人間同士が会話しているかのようです。

Audio interjection | Thinking Machines Lab – YouTube

以下の動画では、Interaction Modelsが異なる言語で話す2人の話者の発声内容をリアルタイムで翻訳しています。ユーザーがコラボレーションにふさわしくないような汚い言葉を発した際、Interaction Modelsはその場にふさわしい形にリアルタイムで会話を翻訳することが可能です。

Simultaneous speech | Thinking Machines Lab – YouTube

以下の動画では、3人のユーザーがInteraction Modelsに雑学知識をテストしてもらっています。Interaction Modelsは数字のカウントダウンを行いながら、ユーザーの回答も正確に検討することができています。

Time-awareness | Thinking Machines Lab – YouTube

Interaction Modelsはユーザーとの会話の中で、インターネット上の情報を検索しながら、リアルタイムで図やグラフを作成し、必要に応じて会話に織り込むことも可能。

Generative UI | Thinking Machines Lab – YouTube

Interaction Modelsはユーザーと会話しながら、思考・処理・情報検索を行うことも可能。以下の動画のように、上映中の映画についておすすめ情報を提供するといったこともできます。

Search | Thinking Machines Lab – YouTube

より長時間のセッションでは、すべてが継続的に行われるため、「AIに指示を与える」というよりも「AIと共同作業する」かのような感覚が得られます。

Diet manager | Thinking Machines Lab – YouTube

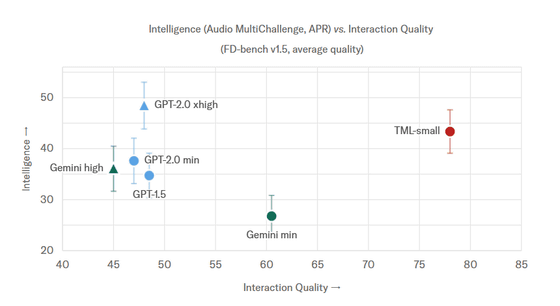

Interaction Modelsの知能・指示追従性と応答品質を、既存のAIモデルと比較した結果をまとめたグラフが以下。グラフではAIの知能と指示追従性に関するベンチマークであるAudio MultiChallengeのスコアが縦軸に、リアルタイム音声AIが人間との「発話のかぶり」や割り込みをどれだけ自然に処理できるかという応答品質を評価するベンチマークであるFull-Duplex-Bench v1.5(FD-bench v1.5)のスコアが横軸に示されており、Interaction Models(TML-Interaction-Small)は特に応答品質において既存のAIモデルと比較して大幅に優れた性能を有していることがよくわかります。

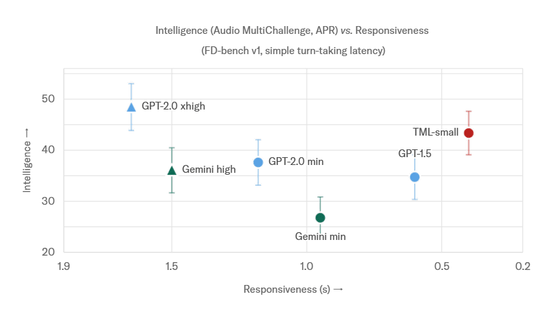

以下はAIの知能をAudio MultiChallenge(縦軸)で、応答性をFD-bench v1のターン取得レイテンシー(横軸)で評価した結果をまとめたグラフ。応答性、つまりはAIによる出力速度が示されており、既存のAIモデルと比較しても応答速度が非常に速いことがよくわかります。

なお、Thinking Machines Labは今後数カ月以内にフィードバックを収集するための限定的な研究プレビュー版を公開予定で、一般公開は「2026年内の予定」とのことです。

この記事のタイトルとURLをコピーする

ソース元はコチラ

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。