アメリカのAI開発企業であるPoolsideがAIモデル「Laguna M.1」と「Laguna XS.2」を2026年4月29日にリリースしました。このうちLaguna XS.2はオープンモデルとして公開されており、GoogleのGemma 4を超える性能を備えています。

Introducing Laguna XS.2 and Laguna M.1 — Poolside

https://poolside.ai/blog/introducing-laguna-xs2-m1

Laguna XS.2 and M.1: A Deeper Dive — Poolside

https://poolside.ai/blog/laguna-a-deeper-dive

Laguna M.1は総パラメーター数2250億、アクティブパラメーター数230億のMoEモデルです。学習には30兆トークンのデータセットが使われており、学習完了時期は2025年末です。何らかのベースモデルに追加学習を施したわけではなく、事前学習も含めてPoolsideによって開発された独自モデルです。

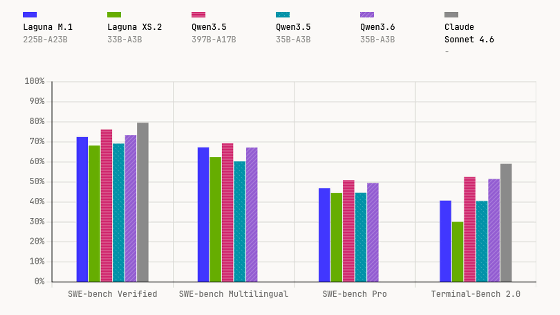

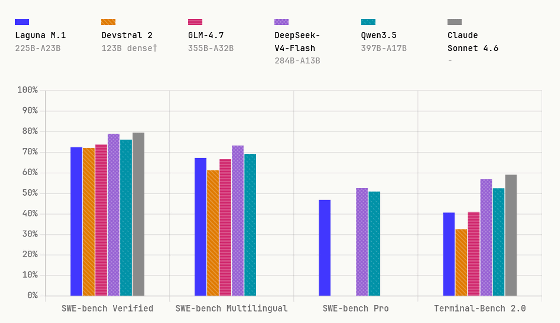

「Laguna M.1」「Devstral 2」「GLM-4.7」「DeepSeek-V4-Flash」「Qwen 3.5」「Claude Sonnet 4.6」の性能を比較したグラフが以下。Devstral 2のスコアは超えていますが、中国製モデルの「GLM-4.7」「DeepSeek-V4-Flash」「Qwen 3.5」には負けています。

Laguna XS.2は総パラメーター数330億、アクティブパラメーター数30億のMoEモデルです。データセットの規模は30兆トークンで、学習データの規模は30兆トークン、学習に費やした時間は5週間です。

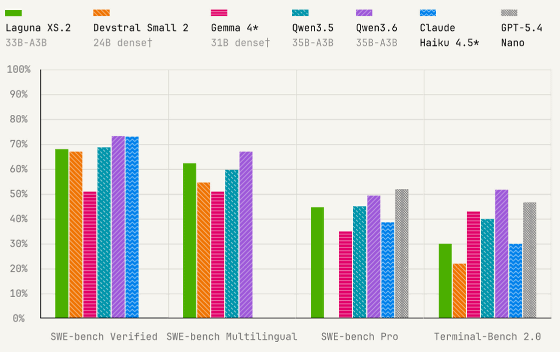

「Laguna XS.2」「Devstral Small 2」「Gemma 4」「Qwen 3.5」「Qwen 3.6」「Claude Haiku 4.5」「GPT-5.4 Nano」のベンチマーク結果は以下の通り。Laguna XS.2は一部のテストで同一規模のQwen 3.5を上回っていますが、Qwen 3.6には敗北しています。

Laguna M.1とLaguna XS.2はAPIを介して利用可能で、API使用料金は期間限定で無料となっています。また、Laguna XS.2はオープンモデルとしても公開されています。Poolsideは「私たちは西側諸国には強力なオープンモデルが必要だと考えており、エコシステムに貢献したいと考えています」と述べ、中国系AI企業に対抗するオープンモデルの必要性を訴えています。

Laguna XS.2は以下のリンク先からダウンロードできます。PoolsideはLaguna XS.2をNVIDIAと協力して開発しており、NVFP4に量子化したバージョンも同時公開しています。さらに、FP8とINT4の量子化バージョンも存在。ライセンスはいずれもApache License 2.0です。

poolside/Laguna-XS.2 · Hugging Face

https://huggingface.co/poolside/Laguna-XS.2

poolside/Laguna-XS.2-FP8 · Hugging Face

https://huggingface.co/poolside/Laguna-XS.2-FP8

poolside/Laguna-XS.2-INT4 · Hugging Face

https://huggingface.co/poolside/Laguna-XS.2-INT4

poolside/Laguna-XS.2-NVFP4 · Hugging Face

https://huggingface.co/poolside/Laguna-XS.2-NVFP4

また、Appleシリコン用のAIフレームワークであるMLXもLaguna-XS.2の実行に対応しています。

Day-zero support for Laguna XS.2 in MLX🔥🚀@poolsideai’s first open-weight model is now supported in MLX.

33B total params, 3B activated, built for agentic coding, and running natively on Apple Silicon.

Huge thanks to team at Poolside for the early collaboration 🙌🏽

Heads up:… https://t.co/I7VdkGHy19

— Prince Canuma (@Prince_Canuma) April 28, 2026

この記事のタイトルとURLをコピーする

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。