中国のAI企業・AlibabaのAI研究チームであるQwen(Tongyi Lab)が2026年4月2日に「Qwen3.6-Plus」を発表し、シリーズ最初のオープンモデル「Qwen3.6-35B-A3B」を2026年4月15日に公開しました。Qwen3.6-35B-A3Bは効率性が高く優れたエージェントコーディング性能を発揮するモデルで、Googleのオープンモデル群であるGemma 4よりも高性能とアピールされています。

Qwen3.6-35B-A3B: Agentic Coding Power, Now Open to All

https://qwen.ai/blog?id=qwen3.6-35b-a3b

Qwen3.6-35B-A3B on my laptop drew me a better pelican than Claude Opus 4.7

https://simonwillison.net/2026/Apr/16/qwen-beats-opus/

1/4 Qwen3.6-35B-A3B: Agentic Coding Power, Now Open Source 🚀

We are excited to release Qwen3.6-35B-A3B, a sparse mixture-of-experts (MoE) model with 35 billion total parameters and only 3 billion active parameters.

Core Capabilities:

• Exceptional Agentic Coding: Engineered… pic.twitter.com/Pf1x2kZAVT— Tongyi Lab (@Ali_TongyiLab) 2026年4月16日

⚡ Meet Qwen3.6-35B-A3B:Now Open-Source!🚀🚀

A sparse MoE model, 35B total params, 3B active. Apache 2.0 license.

🔥 Agentic coding on par with models 10x its active size

📷 Strong multimodal perception and reasoning ability

🧠 Multimodal thinking + non-thinking modes… pic.twitter.com/UMiChPaLid— Qwen (@Alibaba_Qwen) 2026年4月16日

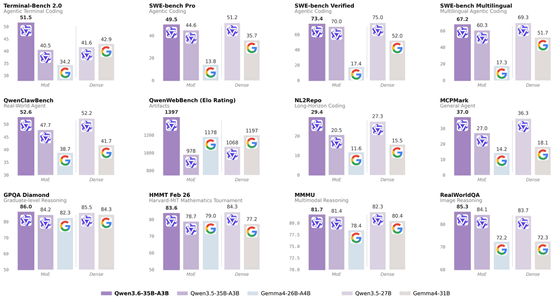

Qwen3.6-35B-A3BはオープンウェイトのMoEモデルで、総パラメータ数350億個、アクティブパラメータ数わずか30億個と効率性の高いモデルでありながら、310億パラメーターを一度に読み込むGemma4-31Bを上回るスコアを示しています。

以下はQwenが発表したベンチマークで、12種のベンチマークでいずれもGemma4-26B-A4BおよびGemma4-31Bを上回っていることが示されています。

Qwenによると、Qwen3.6シリーズは最初からマルチモーダル対応している設計であり、Qwen3.6-35B-A3Bはわずか約30億個のアクティブパラメータという規模からは想像もつかないほどの知覚能力とマルチモーダル推論能力を発揮するそうです。Qwenが実施したほとんどの視覚言語ベンチマークにおいて、Qwen3.6-35B-A3Bの性能はClaude Sonnet 4.5と同等以上だったと報告されています。特に「空間的な構造を理解・記述する能力」においてその強みが顕著であるとのこと。

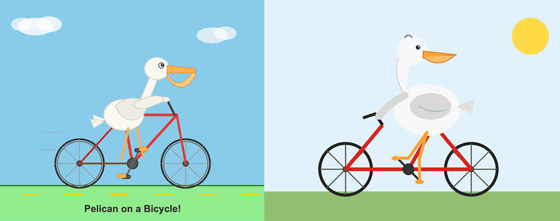

また、エンジニアのサイモン・ウィリソン氏が考案した「自転車に乗ったペリカンを描かせる」というベンチマークでも、Qwen3.6-35B-A3BはClaude Opus 4.7よりも優れたペリカンを描いてくれたとウィリソン氏は報告しています。以下は左がQwen3.6-35B-A3Bによるもの、右がClaude Opus 4.7によるもので、Claude Opus 4.7の自転車はフレームが崩れているように見えます。

ウィリソン氏は「ペリカンベンチマークは冗談として使われたものですが、制作されたペリカンの品質とモデルの一般的な有用性との間に直接的な相関関係があるという奇妙な点がありました。しかし、Anthropicが2026年4月17日に公開した最新モデルのClaude Opus 4.7よりも軽量モデルのQwen3.6-35B-A3Bが高性能で実用的であるとは考えにくいです。あくまでこのベンチマークは、『自転車に乗ったペリカンのSVGイラストが欲しければノートパソコン上で動作するQwen3.6-35B-A3Bの方がClaude Opus 4.7より優れている』ことを示すだけです」と述べています。

Qwen3.6-35B-A3Bは優れたエージェントコーディング機能を備えており、OpenClaw、Claude Code、Qwen Codeなどの人気のあるサードパーティ製コーディングアシスタントにシームレスに統合できます。Qwen3.6-35B-A3BとOpenClawを接続するための手順やスクリプトは公式ブログで公開されています。

Qwen3.6-35B-A3BはHugging FaceおよびModelScopeでセルフホスティング用のオープンウェイトとして、Alibaba Cloud Model Studio APIを介して利用可能です。また、Qwen Studioから試用することもできます。

Qwenは「今後もQwen3.6オープンソースファミリーを拡大し、効率的でオープンなモデルが実現できる可能性の限界を押し広げていきます。コミュニティの皆様からのフィードバックに感謝するとともに、Qwen3.6-35B-A3Bを使って皆様がどのようなものを構築されるのかを楽しみにしています。今後のリリースにご期待ください!」と述べています。

この記事のタイトルとURLをコピーする

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。