中国のAI企業・DeepSeekが、OpenAIのGPT-4oに匹敵するモデルとして2024年12月にリリースした「DeepSeek-V3」のアップデート版「DeepSeek-V3-0324」を公開しました。

deepseek-ai/DeepSeek-V3-0324

https://simonwillison.net/2025/Mar/24/deepseek/

DeepSeek’s New 641GB AI Model Lands Quietly — and Runs Surprisingly Fast on a Mac – WinBuzzer

https://winbuzzer.com/2025/03/24/deepseeks-new-641gb-ai-model-lands-quietly-and-runs-surprisingly-fast-on-a-mac-xcxwbn/

DeepSeek-V3は2024年12月、6710億個という過去最大のパラメーターを持つ大規模言語モデルとして発表されました。

中国のAI企業・DeepSeekがGPT-4oに匹敵するAIモデル「DeepSeek-V3」をリリース、パラメーター数は脅威の6710億個 – GIGAZINE

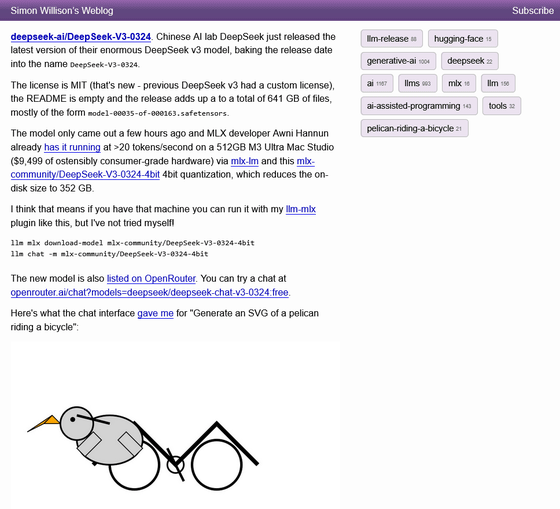

DeepSeek-V3はカスタムライセンスでしたが、新しくリリースされたDeepSeek-V3-0324はオープンソースソフトウェア向けライセンスであるMITライセンスでの公開で、ファイルサイズは合計641GBです。新規モデルではないものの、FP8量子化サポートが組み込まれています。また、パラメーター数は6850億個ですが、推論中にアクティブになるのはそのうちおよそ370億個だけで、ハードウェア要件が緩和されているとのこと。

mlx-community/DeepSeek-V3-0324-4bit · Hugging Face

https://huggingface.co/mlx-community/DeepSeek-V3-0324-4bit

機械学習研究者のアウニ・ハヌン氏は、Apple M3 Ultraチップと512GBのユニファイドメモリを搭載したMac Studioで量子化バージョンを実行し、推論速度が秒間20トークンを超えたことを確認しています。

また、AI研究を行っているXeophon氏はベンチマークを行い、すべてのテストでDeepSeek-V3よりもスコアが跳ね上がったと報告。AnthropicのClaude 3.5 Sonnetを超えて「最高の非推論モデルになりました」とコメントしました。

ニュースサイトのWinBuzzerは、中国はアメリカからのチップ輸入が制限されているので、DeepSeekのように軽量で効率的なアーキテクチャは貴重な存在だと述べています。

この記事のタイトルとURLをコピーする

ソース元はコチラ

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。