NVIDIAがAIデータセンター向けの次世代アーキテクチャ「Blackwell Ultra」「Vera Rubin」「Rubin Ultra」の詳細を発表しました。Blackwell Ultraを搭載した製品は2025年後半に出荷開始予定で、前世代の製品と比べて1.5倍の性能を備えています。

NVIDIA Blackwell Ultra AI Factory Platform Paves Way for Age of AI Reasoning | NVIDIA Newsroom

https://nvidianews.nvidia.com/news/nvidia-blackwell-ultra-ai-factory-platform-paves-way-for-age-of-ai-reasoning

GTC March 2025 Keynote with NVIDIA CEO Jensen Huang – YouTube

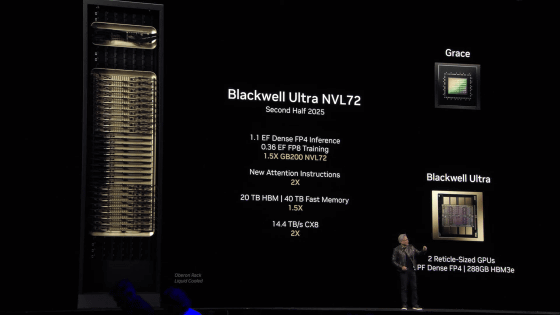

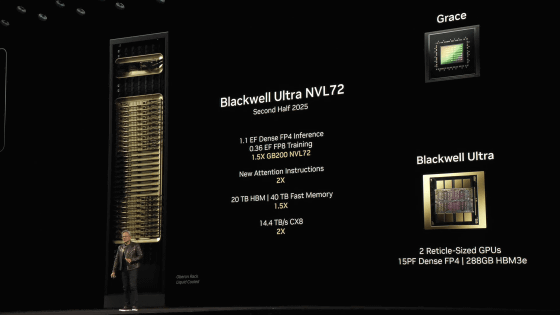

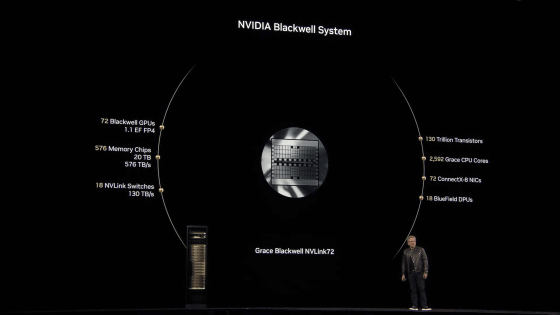

NVIDIAはBlackwell Ultraを採用したデータセンター向けAI処理システム「GB300 NVL72」を発表しました。GB300 NVL72はBlackwell Ultra採用GPUが72個と、ArmベースCPU「NVIDIA Grace」を36個搭載しています。

また、Blackwell Ultraは40TBの高速メモリを搭載しているほか、「Spectrum-X Networking Platform」や「Quantum-X800 InfiniBand Platform 」といった高速通信システムとシームレスに統合されています。これらの特徴によってGB300 NVL72は高速なAI処理を実現しており、前世代モデルの「GB200 NVL72」と比べて1.5倍のAIパフォーマンスを発揮します。また、Hopper世代の製品と比べると収入機会が50倍に増えています。

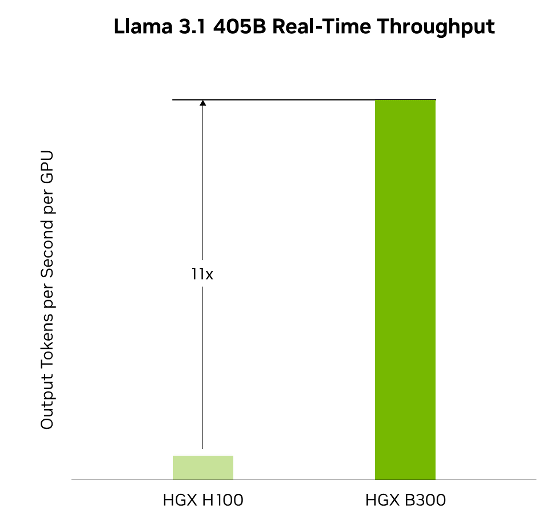

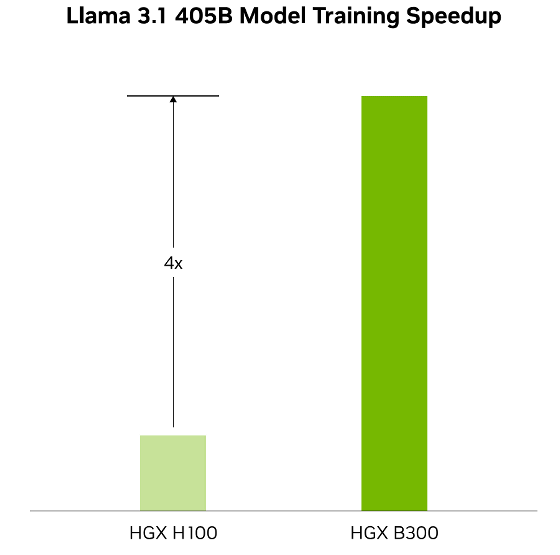

Blackwell Ultraを16個搭載したサーバーボード「HGX B300 NVL16」の場合、「HGX H100」と比べてLlama 3.1 405Bの推論処理速度が11倍に向上します。

また、Llama 3.1 405Bの学習速度は4倍になります。

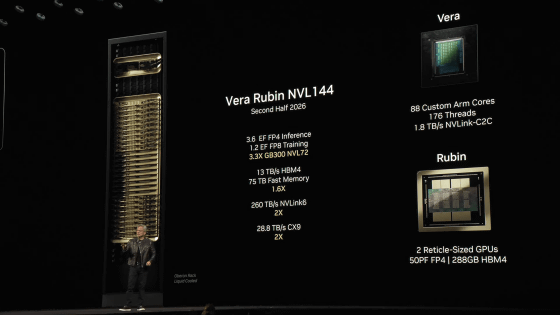

NVIDIAは「Vera Rubin」と「Rubin Ultra」についての情報も公開しました。2026年後半にはVera Rubin採用GPUを搭載したデータセンター向けシステム「Vera Rubin NVL144」が登場予定です。Vera Rubin NVL144は高速メモリを75TB搭載しており、GB300 NVL72の3.3倍の性能を発揮します。

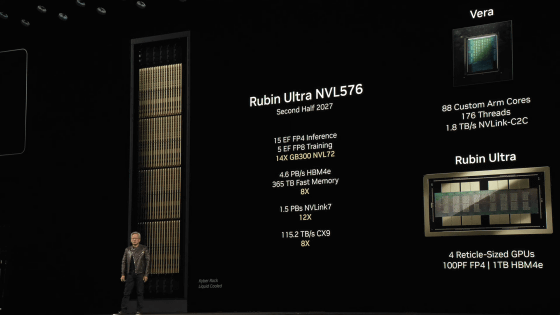

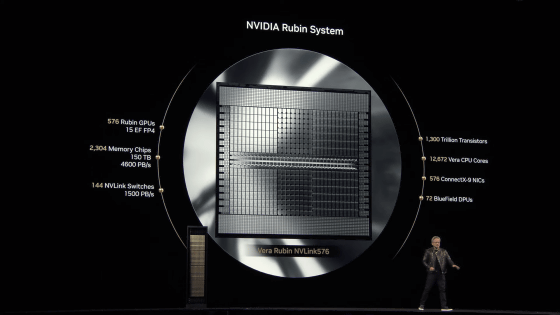

さらに、2027年後半にはRubin Ultra採用GPUを搭載した「Rubin Ultra NVL576」が登場します。Rubin Ultra NVL576のメモリ容量は365TBに達し、GB300 NVL72の14倍の処理性能を備えています。

GB300 NVL72のGPUダイのイメージ図はこんな感じ。トランジスタ数は130兆個です。

そして、Rubin Ultra NVL576のGPUダイのイメージ図が以下。GPUのサイズが巨大化しており、トランジスタ数は1300兆個に達しています。

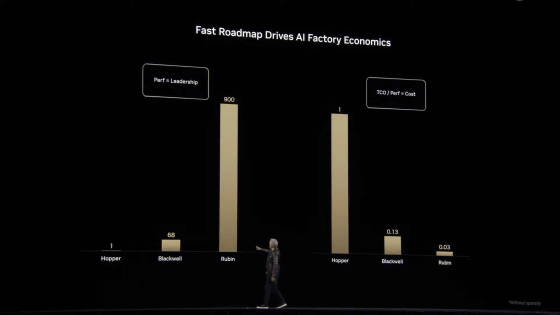

Hopper世代、Blackwell世代、Rubin世代の性能とコストを比較する図が以下。BlackwellはHopperと比べて性能が68倍に向上し、コストが13%に抑えられました。Rubinでは性能がHopperの900倍となり、コストは3%にまで抑えられます。

この記事のタイトルとURLをコピーする

ソース元はコチラ

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。