オープンモデルのAIシリーズ「Kimi」を展開する中国のAIスタートアップのMoonshot AIが、AIの動作精度を検証するツール「Kimi Vendor Verifier(KVV)」をオープンソースで公開しました。

Kimi Vendor Verifier

https://www.kimi.com/blog/kimi-vendor-verifier

Moonshot AIは2026年4月21日にClaude Opus 4.6と同等の性能を誇るオープンモデルの「Kimi K2.6」を公開するなど、有力なモデルを作成しています。

Claude Opus 4.6と同等性能の中国製AIモデル「Kimi K2.6」がオープンモデルとして公開される – GIGAZINE

Moonshot AIはこれまで、コミュニティから「ベンチマークスコアがおかしい」というフィードバックを頻繁に受け取っていたとのこと。調査の結果、ほとんどの場合はデコードパラメータが間違っていることが原因と判明し、API側でいくつかのパラメータを強制的にセットする修正を行いました。

その後、サードパーティのAPIを調査すると公式APIとの間に顕著な違いがあることが判明。Fireworks AIのようにモデルの最高性能を引き出すための努力をしているベンダーも存在する一方で、低品質なモデルを提供するベンダーも存在しています。

Moonshot AIの提供するモデルはオープンモデルで誰でもモデルを実行できますが、品質の制御が難しいことが浮き彫りになりました。ユーザーがMoonshot AI製のモデルをサードパーティベンダー経由で利用し、低品質な応答が返ってきた時、モデルに原因があるのか、サードパーティベンダーの設定に原因があるのかを判別できなければユーザーの信頼を失ってしまいます。

そこで、Moonshot AIはAIが正しく公式と同じ性能を出せているかを検証するツール「KVV」を開発し、オープンソースで公開しました。

GitHub – MoonshotAI/Kimi-Vendor-Verifier: Kimi-Vendor-Verifier · GitHub

https://github.com/MoonshotAI/Kimi-Vendor-Verifier

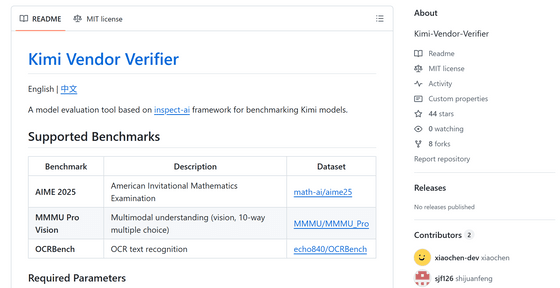

KVVでは以下の6つのベンチマークでモデルの性能を確認するとのこと。

・事前検証

APIのパラメータが正しく適用されているかを検証します。

・OCRBench

マルチモーダルパイプライン向けの5分間のスモークテスト。

・MMMU Pro

多様な視覚入力をテストし、前処理を検証します。

・AIME2025

長時間出力ストレステストで、短時間のベンチマークでは発見できないKVキャッシュのバグや量子化の劣化を検出します。

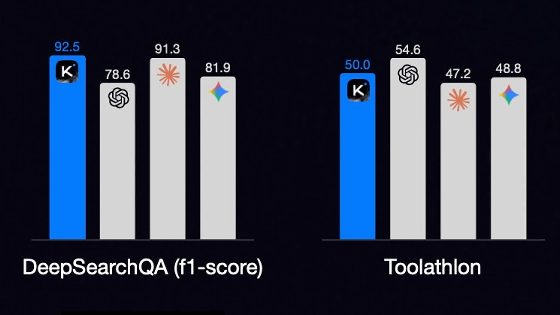

・K2VV ToolCall

一貫性とJSONスキーマの正確性を測定し、ツールエラーを検出します。

・SWE-Bench

完全なエージェント型コーディングテストです。サンドボックスへの依存があるためオープンソースには含まれていません。

また、ベンダー向けにテストモデルへの早期アクセスを提供することで、公開前にベンダーが自社のシステムをチェックできるようにするとのこと。さらにMoonshot AI側でベンダーのAPIを確認し、実績をランキング形式で公開するとしています。

KVVの一連の実行には2台のNVIDIA H20 8GPUを搭載したサーバーで約15時間かかったとのこと。

KVVの公開にあたり、Moonshot AIは「モデルをオープンにすることは戦いの半分に過ぎない。残り半分は他の場所で正しく動作していることを保証することだ」と述べ、サードパーティベンダーにKimi K2.6の正しい実装をさせることに意欲を見せています。

この記事のタイトルとURLをコピーする

ソース元はコチラ

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。