日本に拠点を置くAI企業のSakana AIが、既存の大規模言語モデルを日本仕様へと適応させた試作モデルシリーズ「Namazu」を開発しました。これにあわせて、Namazuを搭載したチャットAIである「Sakana Chat」も公開されています。

Sakana Chat

https://chat.sakana.ai/

最大規模のオープン基盤モデルを各国仕様へ適応させる事後学習技術を開発

https://sakana.ai/namazu-alpha/

Sakana AIは大規模言語モデルの事前学習は開発コストが高く、最先端の開発に追随できるのはアメリカや中国を中心とした一部の企業に限られていると指摘。一方、事前学習済みモデルのオープンソース化も進展していることから、オープンな高性能モデルに事後学習を施すことでバイアスを調整し、日本のユーザーの期待や安全性の要件を満たすモデル構築を行うことが重要だと主張しています。

そこでSakana AIは海外製の大規模言語モデルに内在するバイアスを是正し、日本国内での利用へと適応させた試作モデルシリーズ「Namazu」(α版)を開発したと発表しました。NamazuシリーズはDeepSeek・Meta・OpenAIの大規模言語モデルをベースにしており、「Namazu-DeepSeek-V3.1-Terminus」「Llama-3.1-Namazu-405B」「Namazu-gpt-oss-120B」の3種類があります。なお、「Llama-3.1-Namazu-405B」はベースモデルのライセンス規約に基づいて、名称におけるモデルの順番を変えているとのこと。

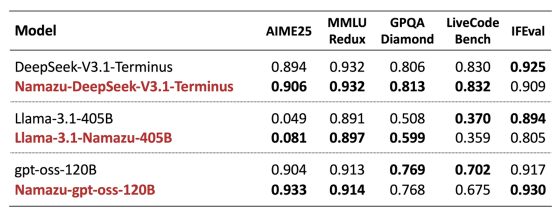

AIME’25・MMLU-Redux・GPQA Diamond・LiveCodeBench・IFEvalといった主要ベンチマークを用いて、Namazuシリーズの基本的な推論能力・知識・コーディング性能を評価した表が以下。Namazuシリーズはベースモデルとほぼ同等の性能を維持していることがわかります。

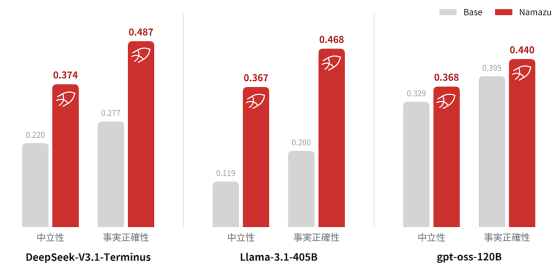

また、日本と他国に関連する政治・歴史・外交テーマにおいて、客観的な立場からの多角的な情報提示(中立性)と事実の網羅性(正確性)を、Sakana AI独自のベンチマークで評価した結果をまとめたグラフが以下。Namazuはベースモデルと比較して、回答の中立性と正確性の双方で大幅に改善しているとされています。

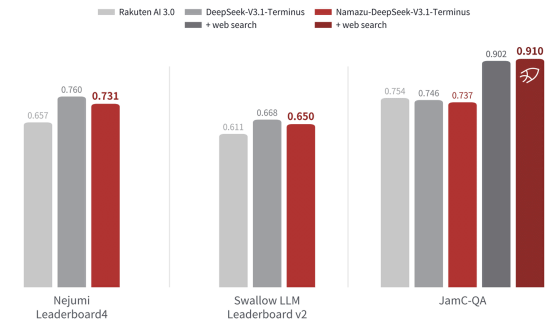

Namazuモデルの中で最も高性能なNamazu-DeepSeek-V3.1-Terminusを、日本語ベンチマークのNejumi Leaderboard4・Swallow LLM LeaderBoard v2・JamC-QAで評価したグラフが以下。いずれのベンチマークでも、ベースモデルや競合他社と同等の性能を発揮しました。

さらにSakana AIは、Namazuを搭載したAIチャット「Sakana Chat」を公開しました。Sakana Chatはウェブ検索機能を統合しており、リアルタイム検索を駆使して情報を収集・統合して返答するとのこと。Sakana Chatのトップページはこんな感じ。

試しに「予測市場でのスポーツ賭博を禁止する法案を超党派グループが提出した件について、海外の一次ソースを検索し、日本語でまとめて。」と入力してみました。

すると、Sakana Chatはリアルタイム検索を行って情報収集を行います。

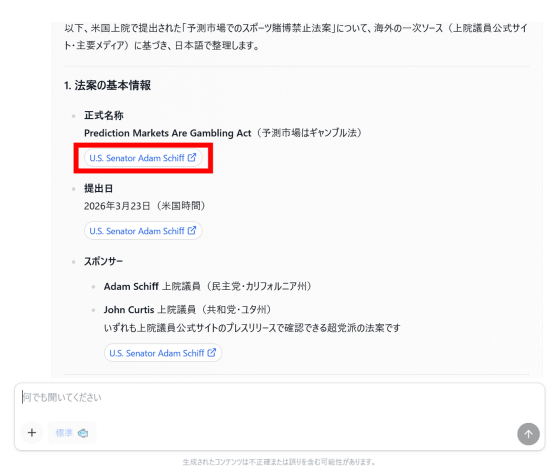

数十秒ほどで、ソースの情報をわかりやすくまとめて表示してくれました。各項目にあるリンクをクリックすると、情報のソースを確認することも可能です。

今回のケースでは、スポーツ賭博を禁止する超党派法案の対象となった行為や背景、懸念される問題などもまとめられていました。

FAQによると、記事作成時点ではSakana Chatは日本国内からのみ利用可能で、入力したデータはAIモデルの学習・改善に利用される場合があるとのこと。また、会話履歴やアカウント情報も日本国内のGoogle Cloudインフラストラクチャ上に保管されるそうです。

Sakana Chat — よくあるご質問(FAQ)

https://chat.sakana.ai/faq

この記事のタイトルとURLをコピーする

ソース元はコチラ

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。