Googleが、「Gemma 3」モデルを基盤とした翻訳モデル群「TranslateGemma」を発表しました。

TranslateGemma: A new family of open translation models

https://blog.google/innovation-and-ai/technology/developers-tools/translategemma/

TranslateGemma Technical Report – 2601.09012v2.pdf

(PDFファイル)https://arxiv.org/pdf/2601.09012

🗣 Introducing TranslateGemma, our new collection of open translation models built on Gemma 3.

The model is available in 4B, 12B, and 27B parameter sizes, and furthers communication across languages, no matter what device you own. https://t.co/dniQD3RPKP

— Google AI Developers (@googleaidevs) January 15, 2026

「TranslateGemma」には4B、12B、27Bのパラメータサイズがあり、55言語間のコミュニケーションを支援できます。4Bはモバイル端末向け、12Bはコンシューマー用ノートPC向け、27Bはクラウド上の単一H100 GPUまたはTPUで実行可能な最上位版で、それぞれオープンモデルとして無料公開されています。ベースモデルの「Gemma」と比較して翻訳能力に強く、いくつかのベンチマークでGemmaを上回る性能を発揮しました。

WMT24++というデータセットでテストしたところ、TranslateGemmaのエラー率はGemmaを大幅に下回りました。Googleは「開発者にとってこれは大きな勝利です。ベースモデルの半数以下のパラメータで高精度の翻訳品質を実現できます。この効率性の飛躍により、精度を犠牲にすることなく、より高いスループットと低いレイテンシが可能になります」とアピールしています。

TranslateGemmaの性能は二段階微調整プロセスで構築されました。1つは教師あり微調整で、人間による翻訳テキストと最先端Geminiモデルが生成した高品質な合成翻訳が豊富に混在したデータセットを使ってベースとなるGemma 3モデルを微調整したとのこと。もう1つは強化学習で、翻訳品質をさらに向上させるためにMetricX-QEやAutoMQMといった高度な指標を含む報酬モデルを活用し、文脈的に正確で自然な翻訳を生成するようモデルを導いたとのことです。

TranslateGemmaはGemma 3のマルチモーダル能力を継承しており、画像から文字を読み取って翻訳する能力にも好影響を与えることが確認されたそうです。これは、TranslateGemmaのトレーニング過程で特定のマルチモーダル微調整を行わずとも実現されたものです。

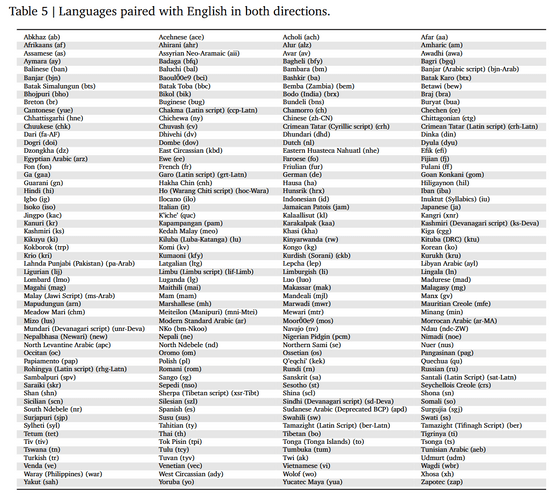

TranslateGemmaは日本語を含む55の言語のペアで厳密に訓練・評価されており、スペイン語、フランス語、中国語、ヒンディー語などの主要言語だけでなく、リソースが少ない多くの言語においても信頼性の高い高品質な性能を保証するとGoogleは説明。「コミュニティの皆様がこれらのモデルを活用し、言語の壁を打ち破り、異文化理解を深めていく様子を見るのが楽しみです」と付け加えました。

英語との双方向翻訳で使用された言語は以下の通り。

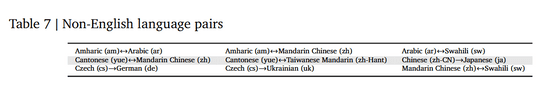

また、英語以外のペアでも訓練・評価されています。

TranslateGemmaのモデルデータは以下のリンク先で公開されています。

TranslateGemma – a google Collection

https://huggingface.co/collections/google/translategemma

この記事のタイトルとURLをコピーする

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。