AI開発企業のLiquid AIがデバイス上でのローカル動作を焦点に当てた小型AIモデル「LFM2.5」を2026年1月5日に公開しました。LFM2.5シリーズには日本語特化の「LFM2.5-1.2B-JP」も含まれており、どのモデルも無料でダウンロード可能となっています。

Introducing LFM2.5: The Next Generation of On-Device AI | Liquid AI

https://www.liquid.ai/blog/introducing-lfm2-5-the-next-generation-of-on-device-ai

LFM2.5シリーズはベースモデルの「LFM2.5-1.2B-Base」、追加学習を施した「LFM2.5-1.2B-Instruct」、日本語特化の「LFM2.5-1.2B-JP」、視覚言語モデルの「LFM2.5-VL-1.6B」、音声言語モデルの「LFM2.5-Audio-1.5B」の5種類があり、すべてオープンモデルとして公開されています。

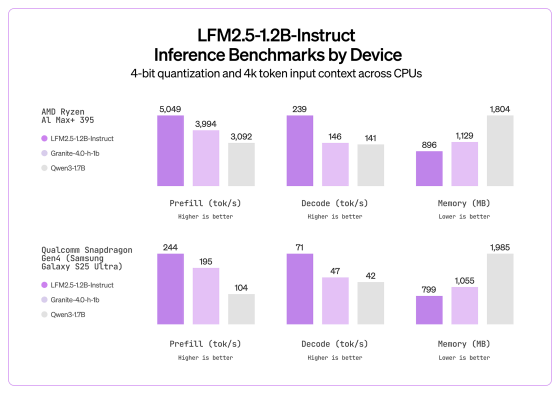

LFM2.5-1.2B-InstructはノートPCやスマートフォンでも動作する軽量なAIモデルです。AMDのRyzen AI Max+ 395を搭載したPCでは毎秒239トークンの出力が可能。SamsungのGalaxy S25 Ultraでも毎秒71トークンの出力が可能です。

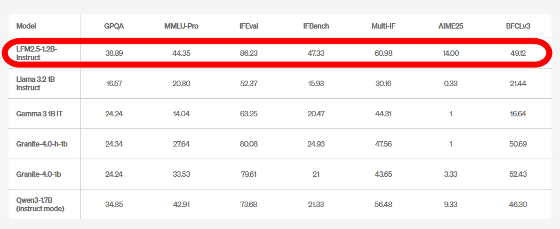

「LFM2.5-1.2B-Instruct」とオープンモデルの「Llama 3.2 1B Instruct」「Gemma 3 1BIT」「Granite-4.0-h-1b」「Granite-4.0-1b」「Qwen3-1.7B」の各種ベンチマーク結果をまとめた表が以下。LFM2.5-1.2B-Instructは同規模のモデルの中で最も高い性能を示しています。

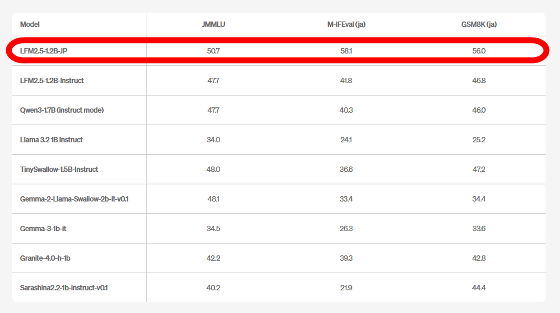

LFM2.5-1.2B-JPは日本語の処理に特化したモデルです。他の言語向けの特化モデルは用意されておらず、日本語特化モデルのみが用意されているのが特徴的。日本語環境での性能を測定するベンチマークでは同規模のモデルと比べて明確に高いスコアを記録しています。

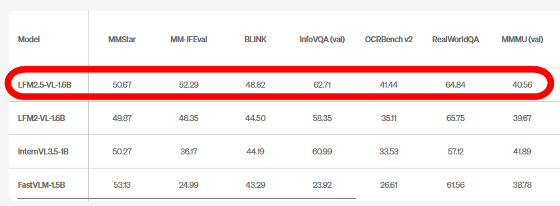

視覚言語モデルのLFM2.5-VL-1.6Bも他のモデルより高い画像認識性能を記録。

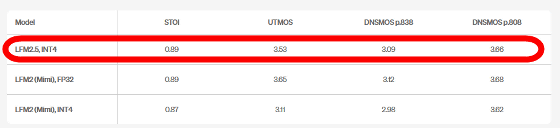

音声言語モデルは量子化を考慮した設計で、軽量なFP4モデルでも前世代のFP32モデルと同等の性能を達成しています。

各種モデルは以下のリンク先で公開されています。

LiquidAI/LFM2.5-1.2B-Base · Hugging Face

https://huggingface.co/LiquidAI/LFM2.5-1.2B-Base

LiquidAI/LFM2.5-1.2B-Instruct · Hugging Face

https://huggingface.co/LiquidAI/LFM2.5-1.2B-Instruct

LiquidAI/LFM2.5-1.2B-JP · Hugging Face

https://huggingface.co/LiquidAI/LFM2.5-1.2B-JP

LiquidAI/LFM2.5-VL-1.6B · Hugging Face

https://huggingface.co/LiquidAI/LFM2.5-VL-1.6B

LiquidAI/LFM2.5-Audio-1.5B · Hugging Face

https://huggingface.co/LiquidAI/LFM2.5-Audio-1.5B

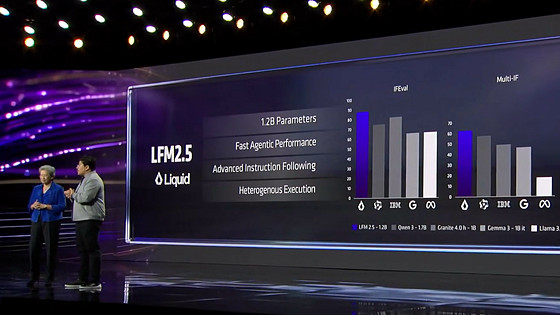

また、Liquid AIのラミン・ハサニCEOは日本時間の2026年1月6日に実施されたAMDのCES基調講演に登壇しており、リサ・スーCEOとともにLFM2.5をアピールしていました。基調講演におけるLFM2.5の説明は以下の動画の53分30秒から確認できます。

また、ハサニCEOはLFM3を2026年中に公開する計画を明らかにしています。LFM3はAMD製プロセッサを搭載したAI PCでローカル動作するように最適化されており、リアルタイムで音声や画像を認識するエージェントとして実行できるそうです。

この記事のタイトルとURLをコピーする

ソース元はコチラ

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。