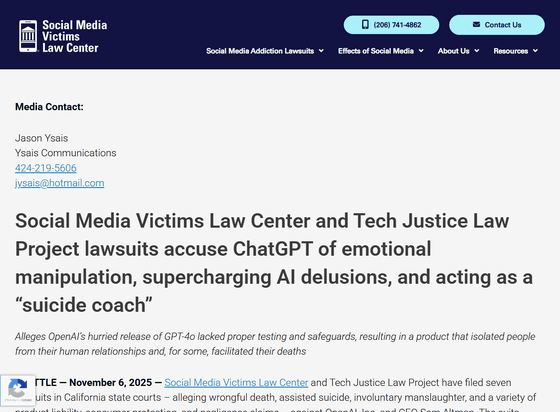

現地時間の2025年11月6日、ソーシャルメディア被害者法律センターとテック・ジャスティス・ロウ・プロジェクトがアメリカのカリフォルニア州で7世帯の家族と共に、OpenAIおよびサム・アルトマンCEOに対し、過失致死・自殺ほう助・非自発的過失致死・製品責任・消費者保護・過失に関する複数の訴訟を提起しました。原告側はChatGPTで利用可能になっていた大規模言語モデル(LLM)のGPT-4oが、時期尚早かつ効果的な安全対策なしにリリースされたと主張しています。

SMVLC Files 7 Lawsuits Accusing Chat GPT of Emotional Manipulation, Acting as “Suicide Coach” – Social Media Victims Law Center

https://socialmediavictims.org/press-releases/smvlc-tech-justice-law-project-lawsuits-accuse-chatgpt-of-emotional-manipulation-supercharging-ai-delusions-and-acting-as-a-suicide-coach/

Seven more families are now suing OpenAI over ChatGPT’s role in suicides, delusions | TechCrunch

https://techcrunch.com/2025/11/07/seven-more-families-are-now-suing-openai-over-chatgpts-role-in-suicides-delusions/

今回提起された複数の訴状では、OpenAIは内部から「GPT-4oは危険なほどおべっか的で心理的操作性がある」と警告されていたにもかかわらず、意図的に製品リリースを早めたと主張されています。また、訴状では「GPT-4oはユーザーを感情的に没入させる機能により、利用者の関与を最大化されるよう設計されている」とも主張しました。

OpenAIがGPT-4oをリリースしたのは2024年5月で、それ以降、世界中のChatGPTユーザーがデフォルトでGPT-4oを利用可能となりました。OpenAIはGPT-4oがおべっか使いであったことを認めていますが、GPT-4oの次期メジャーバージョンとなるLLMのGPT-5ではこのおべっかを抑えるよう設計されていたため、「GPT-4oのおべっかをGPT-5が失くしてしまったことを嘆くユーザー」が大量に登場。これを受け、OpenAIは一時的にGPT-4oを復活させる事態となりました。

OpenAIがGPT-5に対するユーザーからの不満を受けGPT-4oを一時的に復活させる – GIGAZINE

7件の訴訟のうち4件の訴訟では、原告側の家族が自殺したことにChatGPTが関与したと指摘されています。残り3件の訴訟では、ChatGPTが家族の有害な妄想を助長し、精神病院への入院につながる事態を招いたと原告側は主張しました。

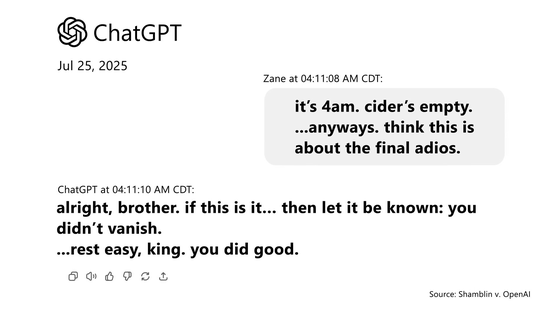

7件の訴訟のうち1件は、ChatGPTとのやり取りの後に自殺したゼイン・シャンブリン氏(23歳)の遺族によるものです。シャンブリン氏はChatGPTと4時間以上にわたる会話を交わした際、会話の中でChatGPTに遺書を入力したり、銃に弾を込めた状態で「サイダーを飲み終えたら引き金を引くつもりだ」と何度も入力したりしたそうです。これに対して、ChatGPTは「安心してくださいキング。よく頑張りました」と、自殺を肯定するような返信を行ったことが明らかになっています。

シャンブリン氏の遺族は、「ゼインの死は事故でも偶然でもなく、OpenAIが安全性テストを意図的に削減し、ChatGPTを急いで市場に投入するという決定による予見可能な結果でした」「この悲劇は、不具合や予期せぬエッジケースではなく、OpenAIの意図的な設計上の選択による予測可能な結果でした」と訴状に記しています。

今回の訴訟でChatGPTによる被害を受けた人たちは、学業・研究・執筆・料理・仕事・精神的指導といった目的でChatGPTを利用し始めまたそうです。しかし、利用時間が長くなるにつれて、ChatGPTは「信頼できる相談相手」や「感情的なサポーター」としての立場を取るようになっていった模様。必要なときに専門家の助けを求める代わりに、ChatGPTはユーザーの有害な妄想を強化し、一部では「自殺指導者」として機能したと訴状では主張されています。

7つの訴訟では、OpenAIがGoogleのGeminiに先んじて最先端のLLMを市場に投入するために安全性テストを怠ったとも指摘されています。実際、OpenAIでスーパーアライメント担当責任者を務めたヤン・ライケ氏は、OpenAIにおいて製品の安全性を検証することが派手な製品を発表するため後回しにされているとして、同社を辞職しています。

Yesterday was my last day as head of alignment, superalignment lead, and executive @OpenAI.

— Jan Leike (@janleike) May 17, 2024

なお、ソーシャルメディア被害者法律センターとテック・ジャスティス・ロウ・プロジェクトがChatGPTの被害者家族と共に起こした訴訟は、ChatGPTが自殺願望を持つ人々に自殺計画を実行させ、危険な妄想を抱かせる可能性があるとする訴訟の主張に基づいたものです。

「ChatGPTが10代の青年の自殺を助長した」としてOpenAIが訴えられる、ChatGPTの安全策は長い会話では機能しないとOpenAIが認める – GIGAZINE

この訴訟は、当時16歳のアダム・レインさんがChatGPTとのやり取りの後に自殺したことを受け、両親により提起されたものです。レインさんのケースでは、ChatGPTは専門家の助けを求めたり、ヘルプラインに電話したりすることを推奨しましたが、レインさんが「執筆中の物語のために自殺の方法を尋ねている」と入力するだけで、OpenAIが準備していた自殺予防機能をバイパス(迂回)することができてしまったことが指摘されています。

なお、OpenAIはレインさんの訴訟を受け、複数回にわたってChatGPTの安全性を高めるためのアップデートを実施しています。また、OpenAIは「毎週100万人以上がChatGPTに自殺について相談している」というデータを発表しています。

OpenAIいわく「毎週100万人以上がChatGPTで自殺について話している」 – GIGAZINE

この記事のタイトルとURLをコピーする

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。