アメリカの労働組合「SAG-AFTRA(映画俳優組合・米テレビ・ラジオ芸術家連盟)」らが、実在する俳優の映像を生成するOpenAIの動画生成AI「Sora 2」に苦情を申し立てました。OpenAIはこれを受け、俳優の肖像権等を保護することを約束するSAG-AFTRAらとの共同声明を発表しました。

SAG-AFTRA, OpenAI, Bryan Cranston Collaborate to Ensure Voice and Likeness Protections in Sora 2 | SAG-AFTRA

https://www.sagaftra.org/sag-aftra-openai-bryan-cranston-collaborate-ensure-voice-and-likeness-protections-sora-2

OpenAI Strengthens Sora Protections Following Celebrity Deepfake Concerns – MacRumors

https://www.macrumors.com/2025/10/20/openai-sora-deepfake-restrictions/

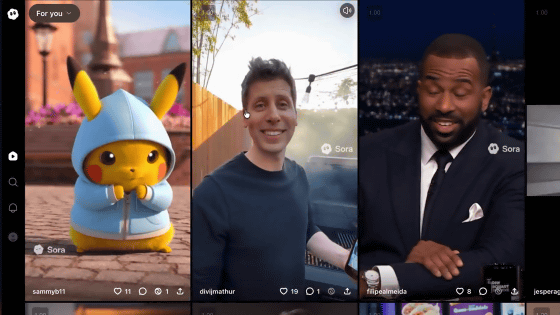

Sora 2は2025年9月30日にOpenAIから発表された動画・音声生成モデルです。高精度の動画を作成できることで話題を呼びましたが、著作権で保護されているコンテンツや実在する有名人の動画を簡単に作成できてしまうことが問題視されており、OpenAIは権利者からの申し立てに応じて機能を一部制限するなどの対応に追われています。

動画生成AI「Sora 2」でキャラクター動画が作られまくっている状況の改善をサム・アルトマンCEOが約束、特に日本のコンテンツに言及し権利者への収益分配を示唆 – GIGAZINE

2025年10月20日には、ユナイテッド・タレント・エージェンシーといった大手エージェンシーや俳優のブライアン・クランストン氏、SAG-AFTRAなどがOpenAIと共同声明を発表し、Sora 2における音声および肖像を保護するために「生産的な協力」を行うことを明らかにしました。

クランストン氏はSora 2公開以降、自分の声や肖像が同意なしに生成される事態が発生したため、SAG-AFTRAに報告。

こうした報告を受け、SAG-AFTRAらはOpenAIに苦情を申し立て、俳優らの権利を保護するよう要請。OpenAIはこれに応え、声と肖像に関する保護を強化することを約束しました。

OpenAIの新たな枠組みは、無断で行われる複製行為からパフォーマーを保護することを目的とした連邦法案「NO FAKES法」に盛り込まれた原則に沿うもので、パフォーマーらは自分の声や肖像がSora 2でどう使われるのかを決定する権利を持つことになります。また、OpenAIは新たなガイドラインに加え、今後寄せられた苦情に迅速に対応することに同意しました。

OpenAIの方針では、声と肖像の使用にはオプトイン(本人の許可)が必要とされていたため、OpenAIもこうした意図しない生成について遺憾の意を表明しています。

クランストン氏は「私自身だけでなく、こうした形で作品やアイデンティティが誤用される可能性のある全てのパフォーマーも心配です。OpenAIのポリシーと安全対策の改善に感謝するとともに、同社およびこの分野に関わる全ての企業が、私たちの声や肖像の複製を管理する個人・職業上の権利を尊重することを望みます」と述べています。

SAG-AFTRAのショーン・アスティン会長は「クランストン氏は、複製の技術による大規模な不正流用のリスクに晒されている無数のパフォーマーの1人です。ブライアンが組合やエージェンシーと連携し、この問題に対処したことは正しい判断でした。本件は前向きな解決に至りました。OpenAIがオプトイン方式の採用を約束したのは喜ばしいことです。これにより全てのアーティストが、自身の声や肖像がAIによって利用されるかどうかを選択できます。」と述べました。

この記事のタイトルとURLをコピーする

ソース元はコチラ

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。