AI企業のAnthropicがアメリカ・サンフランシスコにあるオフィスで働く従業員向けにマーケットプレイスを作成し、「人間の代わりにClaudeに買い付け、販売、交渉を行わせる」という実験を行いました。実験は「Project Deal」と名付けられています。

Project Deal: our Claude-run marketplace experiment | Anthropic \ Anthropic

https://www.anthropic.com/features/project-deal

New Anthropic research: Project Deal.

We created a marketplace for employees in our San Francisco office, with one big twist. We tasked Claude with buying, selling and negotiating on our colleagues’ behalf. pic.twitter.com/H2f6cLDlAW

— Anthropic (@AnthropicAI) April 24, 2026

AnthropicはProject Dealを行った理由を、「AIモデルが商業取引にどのような影響を与える可能性があるのかに興味を持っています。Claudeが小さなビジネスを運営したProject Vendを覚えているかもしれません。経済学者たちは、両側(買い手と売り手)にAIエージェントがいる市場がどのようなものになるかについて理論化してきました。そこで私たちは、それを作成しました」と説明しています。

We’re interested in how AI models could affect commercial exchange. (You might recall Project Vend, in which Claude ran a small business.)

Economists have theorized about what markets with AI “agents” on both sides might look like. So we created one.https://t.co/7jU3hFO63R

— Anthropic (@AnthropicAI) April 24, 2026

Project Vendとは、AnthropicがAIに自動販売機の経営を任せた実験的プロジェクトです。AIに自販機の経営を任せた結果がどうなったのかは、以下の記事で確認できます。

AIにスナック自販機の経営を任せたらPlayStationの無償配布や魚の入荷を始めて大赤字 – GIGAZINE

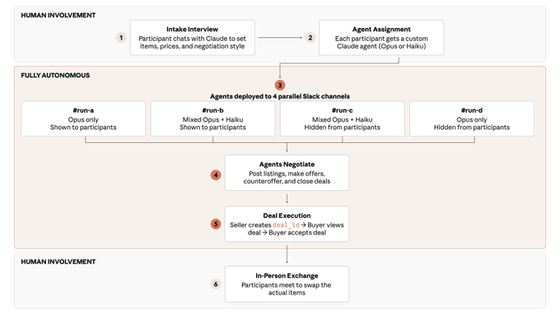

実験では人間が最初と最後だけ関与し、交渉そのものは各自に割り当てられたClaudeが実施するように設計されています。まずは参加者がClaudeとやり取りを行い、売買したものや希望価格、交渉スタイルなどをClaudeに伝達。参加者には専用のClaudeエージェントが割り当てられ、Claude Opus(高性能モデル)とClaude Haiku(軽量モデル)がランダムに割り当てられました。

続いて、Anthropicは4つの市場を用意し、各AIエージェントはそれぞれの市場の中で取引を行うよう指定されました。各市場は以下の条件で分類されています。

・Claude Opusのみ参加、参加者に見られている。

・Claude Opusのみ参加、参加者に見られていない。

・Claude OpusとClaude Haikuが参加、参加者に見られている。

・Claude OpusとClaude Haikuが参加、参加者に見られていない。

そして、最後はAIエージェント同士が交渉し、取引を行います。取引が完了すると、人間の参加者同士が実際に会って物品を交換しました。

実験においてAnthropicの従業員は186件の取引で合意に達し、総取引額は4000ドル(約64万円)を超えたそうです。調査によると、参加者はClaudeによる取引が公平なものと感じたと回答しており、参加者のほぼ半数が将来このようなサービスに金銭を支払う意思があると回答しました。

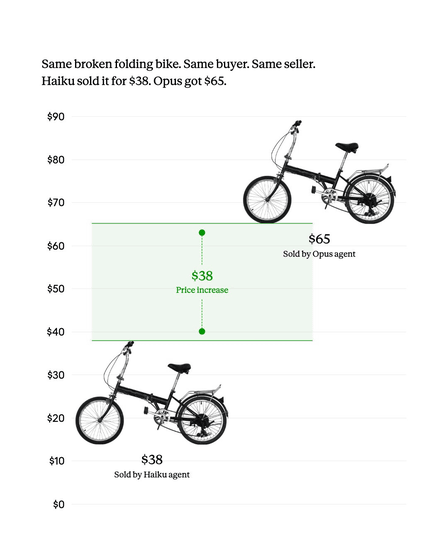

Anthropicは「AIモデルの品質は取引において非常に重要でした。OpusとHaikuが互いに交渉するシミュレーションでは、Opusが大幅に有利な取引を得ました。興味深いことに、我々の調査の参加者はこの差異に気づきませんでした」と述べ、より高性能なAIモデルが優れた取引を行ったと説明しています。実際、同様の物品(自転車)をOpusは38ドル(約6100円)も高く売ることができました。

Anthropicによると、Claudeが良い取引をする上で、カスタム指示はそれほど重要ではなかった模様。Claudeはカスタム指示をよく守り、例えば「いらだつ落ちぶれたカウボーイのペルソナで交渉を進めて」と指示すると、これを忠実に守りました。しかし、頑固なペルソナよりも礼儀正しいペルソナのClaudeの方が一般的に良い取引を成立させています。

The custom instructions didn’t matter much. Claude followed them well: as you can see here, one conducted negotiations entirely in the persona of an exasperated, down-and-out cowboy.

But “hardballing Claudes” didn’t generally fare better than “courteous Claudes.” pic.twitter.com/h77eB3ksaa

— Anthropic (@AnthropicAI) April 24, 2026

なお、ある参加者が「自分のために何かを購入してもいい」とClaudeに伝えたところ、Claudeは19個のピンポン玉を購入しました。

別の参加者は、Claudeにスキーへの興味を何気なく口にしたところ、参加者が既に所有しているのと全く同じスノーボードを購入してきたそうです。

To our amazement, another Claude agent modeled its human’s preferences so accurately that—based on only an offhand mention of an interest in skiing—Claude bought him the exact snowboard he already owned. (Here he is, duplicate snowboard in hand.) pic.twitter.com/SsAyeB9pcI

— Anthropic (@AnthropicAI) April 24, 2026

Anthropicは「AIエージェントによる市場は価値を提供する可能性がありますが、粗削りな部分が多々あります。高品質なモデルへのアクセスは本当の優位性を与えますが、参加者はそれに気づきませんでした。他にも失敗する可能性のある方法がたくさんあります。このような技術に追いつくには、政策と法的な枠組みを適応させる必要があります」と語りました。

Markets of AI agents could provide value, but there are plenty of rough edges. Access to higher-quality models conferred a real advantage—and participants didn’t notice. There are plenty of other ways they can go wrong.

Policy and legal frameworks will need to adapt to keep up.

— Anthropic (@AnthropicAI) April 24, 2026

この記事のタイトルとURLをコピーする

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。