2025年10月7日、Googleがウェブブラウザの操作に特化したAIエージェント「Gemini 2.5 Computer Use」を発表しました。Gemini 2.5 Computer Useはフォームへの入力、ドロップダウンやフィルターなどのインタラクティブな要素の操作、そしてログインの背後での操作をネイティブに行うことが可能です。

Introducing the Gemini 2.5 Computer Use model

https://blog.google/technology/google-deepmind/gemini-computer-use-model/

Gemini 2.5 Computer Useは、人間のようにコンピューターの画面を操作するために特別に設計されたAIモデルで、Gemini 2.5 Proが持つ高度な視覚理解能力と論理的思考力を基盤としており、ウェブサイトのフォーム入力やボタンのクリックといった、これまでAPI経由では難しかった操作を自動化するエージェントを動かすことが可能です。

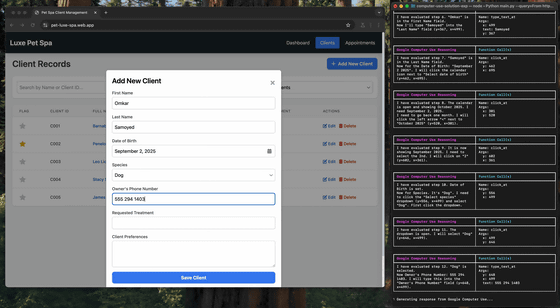

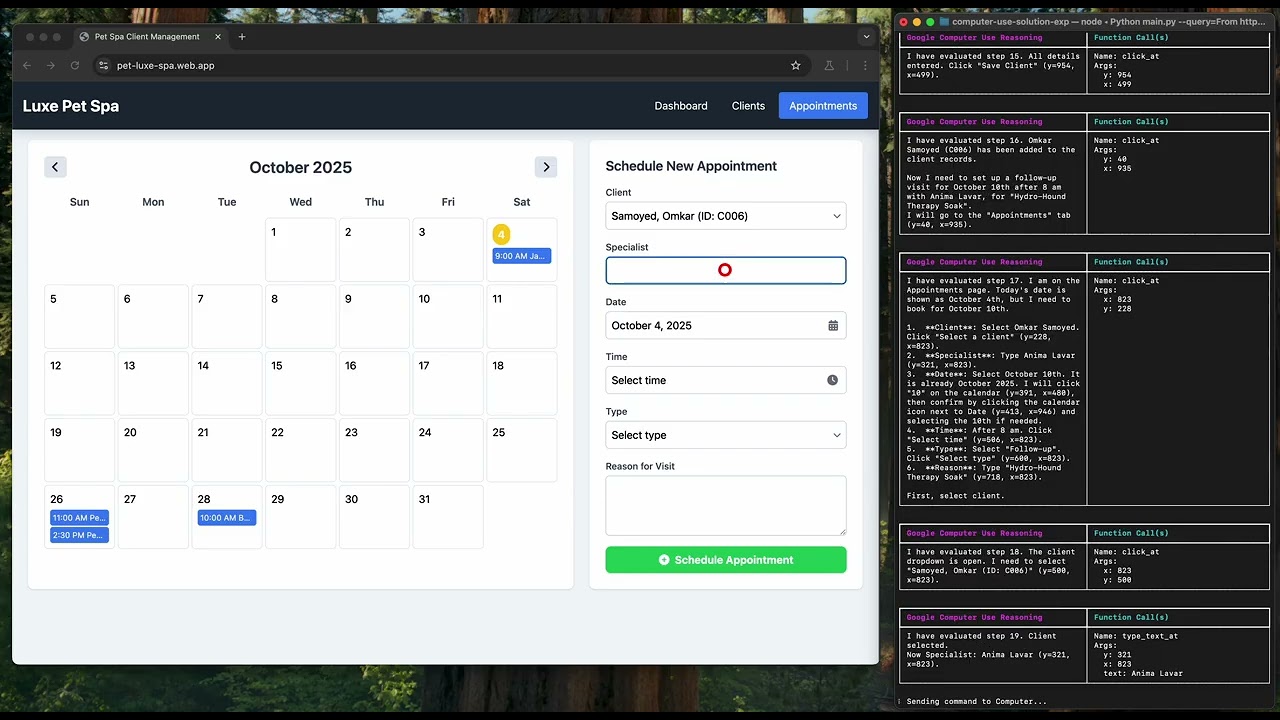

実際にGemini 2.5 Computer Useにタスクを指示したところが以下。プロンプトは「指定したURLから、カリフォルニア州在住のペットに関する詳細情報をすべて取得し、当スパの顧客管理システムにゲストとして登録してください。その後、専門家アニマ・ラヴァールによるフォローアップ診察を10月10日午前8時以降の任意の時間帯に設定してください。診察の理由は、依頼された治療内容と同じです」というもの。

Gemini 2.5 Computer Use Model Demo – Pet Spa – YouTube

Gemini 2.5 Computer Useは指示された通り、抽出した情報を呼び出したフォームへ自動的に入力しています。

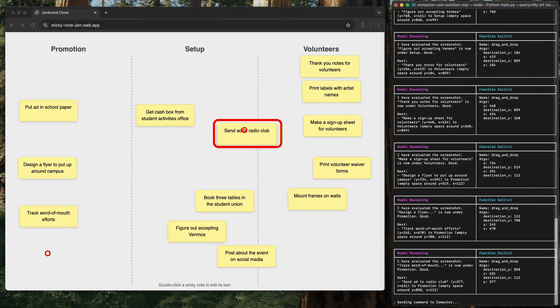

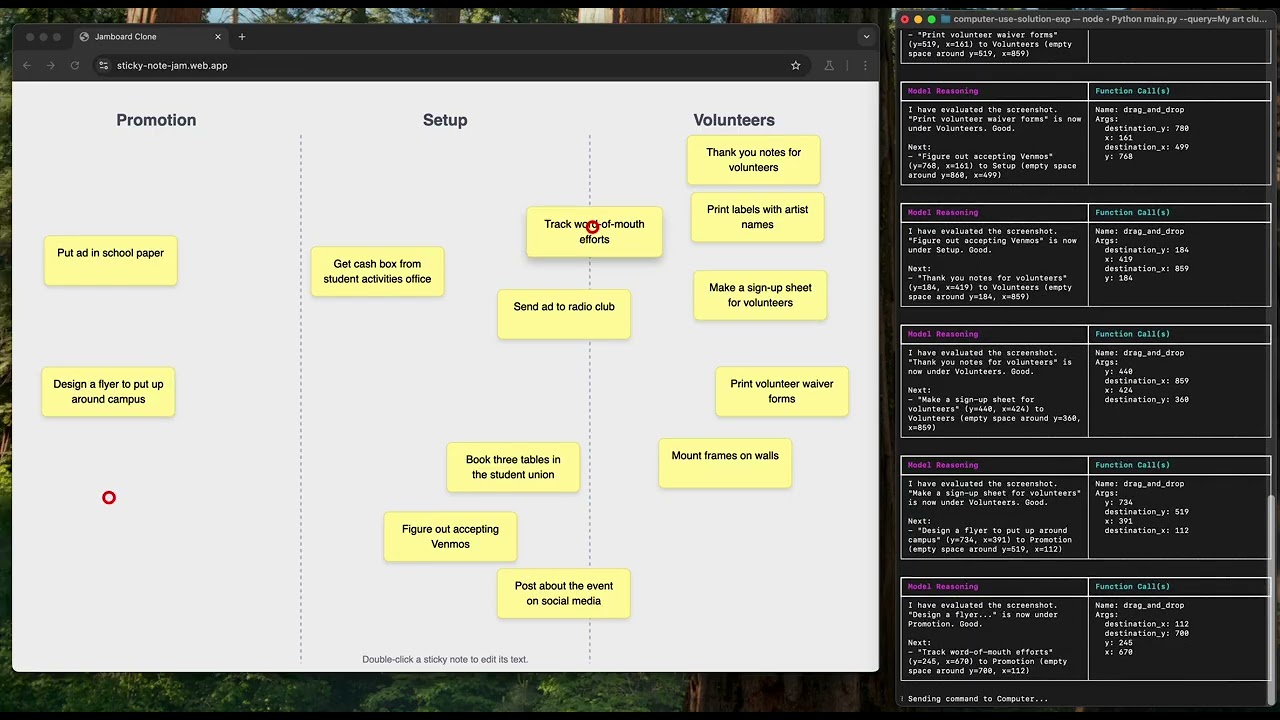

「美術部で展示会に向けたタスクをブレインストーミングしました。ボードがごちゃごちゃしているので、私が作ったカテゴリーにタスクを整理するお手伝いをお願いします。指定したURLにアクセスし、ノートが正しいセクションに明確に分類されていることを確認してください。分類されていない場合はドラッグして移動させてください」というプロンプトで作業させた場合が以下。

Gemini 2.5 Computer Use Model Demo – Sticky Notes – YouTube

ボードにあるタスクカードはマウスでドラッグして操作しますが、Gemini 2.5 Computer Useのエージェントは問題なくタスクカードを動かして整理しています。

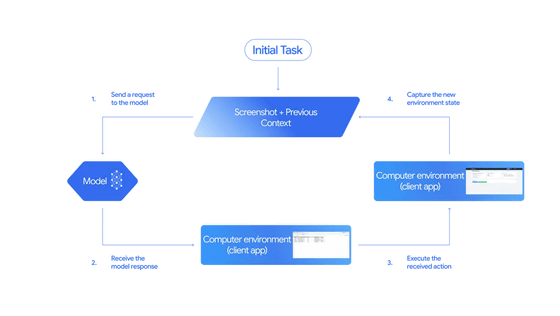

Gemini 2.5 Computer Useモデルの最大の特徴は、「ループ」と呼ばれる繰り返し構造の中で動作する点です。これは、人間がコンピューターを操作する時の「画面を見る→何をすべきか考える→実際に操作する→結果を確認する」という一連の流れを模倣したものです。

具体的には、以下の4つのステップをタスクが完了するまで繰り返します。

1:状況の送信

まず、ユーザーからの指示とスクリーンショット、そして直前に行った操作の履歴をモデルに送ります。これにより、モデルは人間が画面を見るのと同じように、現在の状況を正確に把握します。

2:モデルの判断

送られてきた情報を基にモデルが次に何をすべきかを判断し、「このボタンをクリックする」「このテキストボックスに文字を入力する」といった具体的な操作を決定します。ただし、商品の購入など重要な特定アクションについては、実行前にユーザーへ確認することが必須となっています。

3:アクションの実行

モデルが決定した操作を、クライアント側のプログラムがコンピューター上で実際に実行します。

4:結果の確認と繰り返し

操作が実行された後の新しい画面のスクリーンショットを撮り、再びモデルに送ることでループが再開されます。このサイクルを繰り返すことで、複数のステップにまたがる複雑なタスクでも、一つずつ着実にこなしていくことができます。

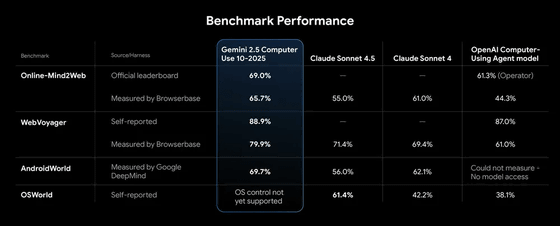

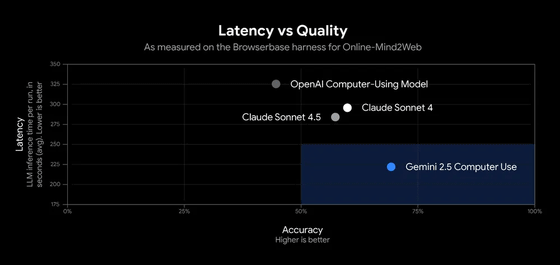

Gemini 2.5 Computer UseはGemini 2.5 Proをベースにしており、複数のウェブおよびモバイル制御ベンチマークで優れたパフォーマンスを示しているとのこと。Claude Sonnet 4.5やClaude Sonnet 4、OpenAIのComputer-Using Agentとベンチマークの結果を比較した表が以下で、複数のベンチマークでGemini 2.5 Computer Useが他モデルを上回るスコアをたたき出しています。

特に、「Online-Mind2Web」におけるBrowserbaseハーネスのパフォーマンスでは、低遅延を維持しながら高い精度のブラウザ制御を実現していることが示されています。

Gemini 2.5 Computer Useモデルはパブリックプレビューとして公開され、Google AI StudioおよびVertex AIのGemini APIを通じてアクセスできます。また、Browserbaseが提供するデモ環境ですぐにモデルの性能を試すことが可能です。

この記事のタイトルとURLをコピーする

ソース元はコチラ

この記事は役に立ちましたか?

もし参考になりましたら、下記のボタンで教えてください。